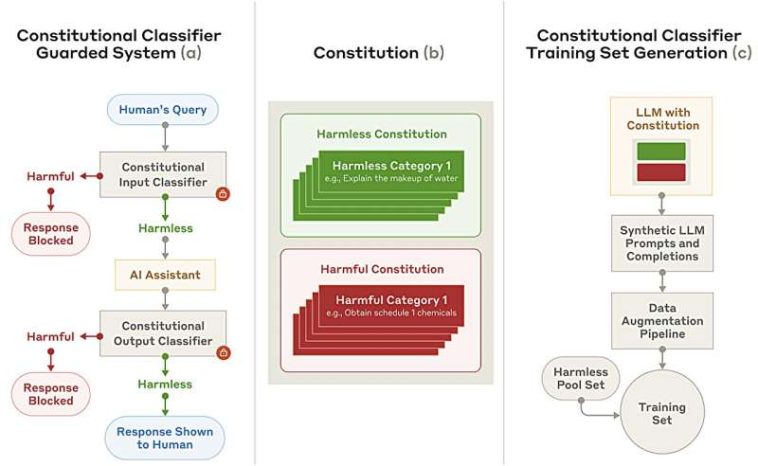

Clasificadores constitucionales. (a) Para defender LLM contra jailbreaks universales, utilizamos salvaguardas del clasificador que monitorean las entradas y salidas. (b) Para entrenar estas salvaguardas, utilizamos una constitución que define las categorías de contenido dañino e inofensivo, lo que permite una rápida adaptación a los nuevos modelos de amenazas. (c) La constitución se usa para generar datos sintéticos que luego usamos en la capacitación. Además, utilizamos grupos de entradas y salidas benignas junto con el aumento de datos para un mejor rendimiento. Crédito: arxiv (2025). Doi: 10.48550/arxiv.2501.18837

Un gran equipo de ingenieros informáticos y especialistas en seguridad del fabricante de aplicaciones AI Anthrope ha desarrollado un nuevo sistema de seguridad destinado a prevenir jailbreaks de chatbot. Su papel se publica en el arxiv servidor de preimpresión.

Desde que los chatbots estuvieron disponibles para uso público, los usuarios han encontrado formas de hacer que respondan preguntas que los creadores de los chatbots han tratado de prevenir. Los chatbots no deben proporcionar respuestas a preguntas como cómo robar un banco, por ejemplo, o cómo construir una bomba atómica. Los fabricantes de chatbot han estado agregando continuamente bloques de seguridad para evitar que causen daños.

Desafortunadamente, prevenir tales jailbreaks ha demostrado ser difícil frente a una avalancha de usuarios determinados. Muchos han descubierto que las consultas de redacción de maneras extrañas pueden eludir los bloques de seguridad, por ejemplo. Aún más desafortunado es que los usuarios encontraron una manera de llevar a cabo lo que se conoce como jailbreaks universales, en los que un comando anula todas las salvaguardas integradas en un chatbot dado, colocándolos en lo que se conoce como «modo de Dios».

En este nuevo esfuerzo, el equipo de Anthrope (Maker of the Claude LLMS) ha desarrollado un sistema de seguridad que utiliza lo que describen como clasificadores constitucionales. Afirman que el sistema es capaz de frustrar la gran mayoría de los intentos de jailbreak, al tiempo que devuelve pocas reestructuras, en las que el sistema se niega a responder consultas benignas.

Los clasificadores constitucionales utilizados por antrópico se basan en lo que se conoce como AIS constitucional, un sistema basado en la inteligencia artificial que busca usar valores humanos conocidos basados en listas proporcionadas. El equipo de Anthrope creó una lista de 10,000 indicaciones que están prohibidas bajo ciertos contextos y han sido utilizados por jailbreakers en el pasado.

El equipo también los tradujo a múltiples idiomas y usó diferentes estilos de escritura para evitar que se deslicen. Terminaron alimentando su sistema lotes de consultas benignas que podrían resultar en sobrecositías, e hicieron ajustes para asegurarse de que no fueran marcados.

Luego, los investigadores probaron la efectividad de su sistema utilizando su propio soneto Claude 3.5 LLM. Primero probaron un modelo de referencia sin el nuevo sistema y descubrieron que el 86% de los intentos de jailbreak fueron exitosos. Después de agregar el nuevo sistema, ese número cayó a 4.4%. Luego, el equipo de investigación puso el Claude 3.5 Sonnet LLM con el nuevo sistema de seguridad disponible para un grupo de usuarios y ofreció una recompensa de $ 15,000 a cualquiera que pudiera tener éxito en un jailbreak universal. Más de 180 usuarios lo intentaron, pero nadie podría reclamar la recompensa.

Más información:

Mrinank Sharma et al, clasificadores constitucionales: defender contra jailbreaks universales a través de miles de horas de equipo rojo, arxiv (2025). Doi: 10.48550/arxiv.2501.18837

© 2025 Science X Network

Citación: Clasificadores constitucionales: el nuevo sistema de seguridad reduce drásticamente los jailbreaks de chatbot (2025, 5 de febrero) Recuperado el 5 de febrero de 2025 de https://techxplore.com/news/2025-02-Constitutional-drasticalmente Chatbot-Jailbreaks.html

Este documento está sujeto a derechos de autor. Además de cualquier trato justo con el propósito de estudio o investigación privada, no se puede reproducir ninguna parte sin el permiso por escrito. El contenido se proporciona solo para fines de información.

GIPHY App Key not set. Please check settings