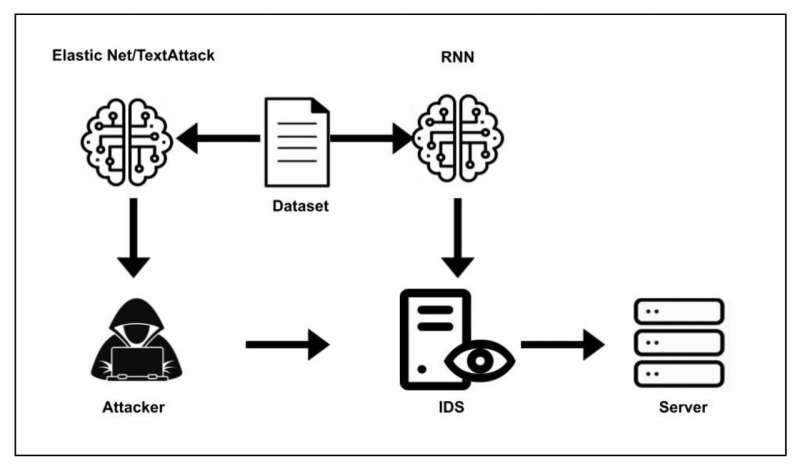

Diagrama que describe la estructura del experimento del equipo. Crédito: Mathews et al.

Las técnicas de aprendizaje profundo han demostrado recientemente ser muy prometedoras para detectar ataques de ciberseguridad y determinar su naturaleza. Al mismo tiempo, muchos ciberdelincuentes han estado ideando nuevos ataques destinados a interferir con el funcionamiento de varias herramientas de aprendizaje profundo, incluidas las de clasificación de imágenes y procesamiento de lenguaje natural.

Quizás el más común entre estos ataques son los ataques adversarios, que están diseñados para «engañar» a los algoritmos de aprendizaje profundo utilizando datos que se han modificado, lo que los lleva a clasificarlos incorrectamente. Esto puede conducir al mal funcionamiento de muchas aplicaciones, sistemas biométricos y otras tecnologías que operan a través de algoritmos de aprendizaje profundo.

Varios estudios anteriores han demostrado la eficacia de diferentes ataques adversarios para provocar que las redes neuronales profundas (DNN) hagan predicciones poco confiables y falsas. Estos ataques incluyen el ataque Carlini & Wagner, el ataque Deepfool, el método de señal de gradiente rápido (FGSM) y el ataque Elastic-Net (ENA).

Los investigadores de Citadel desarrollaron recientemente un DNN que puede detectar un tipo de ataque cibernético conocido como amplificación de DSN de denegación de servicio distribuido (DDoS), y luego usaron dos algoritmos diferentes para generar ejemplos contradictorios que podrían engañar a su DNN. Sus hallazgos, publicados en un artículo publicado previamente en arXiv, confirman aún más la falta de confiabilidad de los métodos de aprendizaje profundo para la detección de ataques DSN y su vulnerabilidad a los ataques adversarios.

Los ataques de amplificación DDoS DSN aprovechan las vulnerabilidades de los servidores del sistema de nombres de dominio (DNS) para amplificar las consultas que se les realizan, inundándolos finalmente con información y haciendo que los servidores se caigan. Estos ataques pueden causar una interrupción significativa de los servicios en línea, incluidos los administrados por pequeñas y grandes empresas multinacionales.

En los últimos años, los informáticos han desarrollado varias técnicas de aprendizaje profundo que pueden detectar ataques de amplificación DDoS DSN. No obstante, el equipo de la Ciudadela demostró que estas técnicas se pueden eludir utilizando redes antagónicas.

«Gran parte del trabajo actual en el campo del aprendizaje contradictorio se ha realizado en el procesamiento de imágenes y el procesamiento del lenguaje natural con una amplia variedad de algoritmos», escribieron Jared Mathews y sus colegas en su artículo. «Dos algoritmos de interés son Elastic-Net Attack on Deep Neural Networks (EAD) y TextAttack».

EAD y TextAttack son dos algoritmos que han demostrado ser particularmente buenos para crear datos manipulados que los DNN clasificarían erróneamente. Mathews y sus colegas desarrollaron una técnica para detectar ataques de amplificación DSN de DDOS y luego intentaron engañarla utilizando datos contradictorios generados por los algoritmos EAD y TextAttack.

«En nuestro experimento, los algoritmos EAD y TextAttack se aplican a un clasificador de amplificación del sistema de nombres de dominio», escribieron los investigadores en su artículo. «Los algoritmos se utilizan para generar ejemplos adversarios de DDoS maliciosos para luego alimentar como entradas a la red neuronal de los sistemas de detección de intrusos para clasificar como tráfico válido».

En sus pruebas, Mathews y sus colegas encontraron que los datos contradictorios generados por EAD y TextAttack podían engañar a su DNN para la detección de ataques de amplificación DDoS DSN el 100 % y el 67,63 % de las veces, respectivamente. Por lo tanto, estos resultados resaltan las fallas y vulnerabilidades significativas de los métodos existentes basados en el aprendizaje profundo para detectar estos ataques.

«Demostramos que tanto el procesamiento de imágenes como los algoritmos de aprendizaje contradictorio del procesamiento del lenguaje natural se pueden aplicar contra una red neuronal de detección de intrusos en la red», escribieron los investigadores en su artículo.

En el futuro, el trabajo de este equipo de investigadores de la Ciudadela podría inspirar el desarrollo de herramientas más efectivas para detectar ataques de amplificación de DSN DDoS, que pueden detectar datos adversarios y clasificarlos correctamente. En sus próximos estudios, los investigadores planean probar la efectividad de los ataques adversarios en un tipo particular de algoritmos para detectar ataques de amplificación de DNS, aquellos que se dirigen al llamado protocolo de aplicación restringida (CoAP) utilizado por muchos dispositivos IoT.

Engañar a las redes neuronales profundas para la detección de objetos con logotipos 3D adversarios

Jared Mathews, Prosenjit Chatterjee, Shankar Banik, Cory Nance, Un enfoque de aprendizaje profundo para crear ataques de amplificación de DSN. arXiv:2206.14346v1 [cs.CR], arxiv.org/abs/2206.14346

© 2022 Ciencia X Red

Citación: Una técnica de aprendizaje profundo para generar ataques de amplificación de DSN (14 de julio de 2022) recuperado el 14 de julio de 2022 de https://techxplore.com/news/2022-07-deep-technique-dsn-amplification.html

Este documento está sujeto a derechos de autor. Aparte de cualquier trato justo con fines de estudio o investigación privados, ninguna parte puede reproducirse sin el permiso por escrito. El contenido se proporciona únicamente con fines informativos.