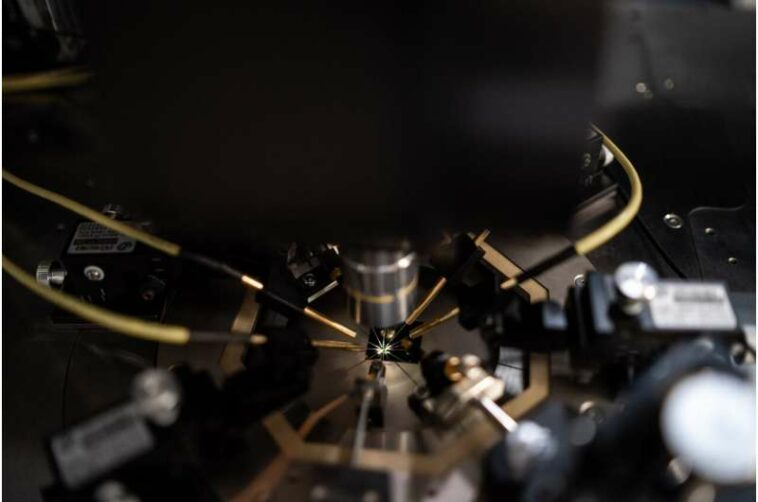

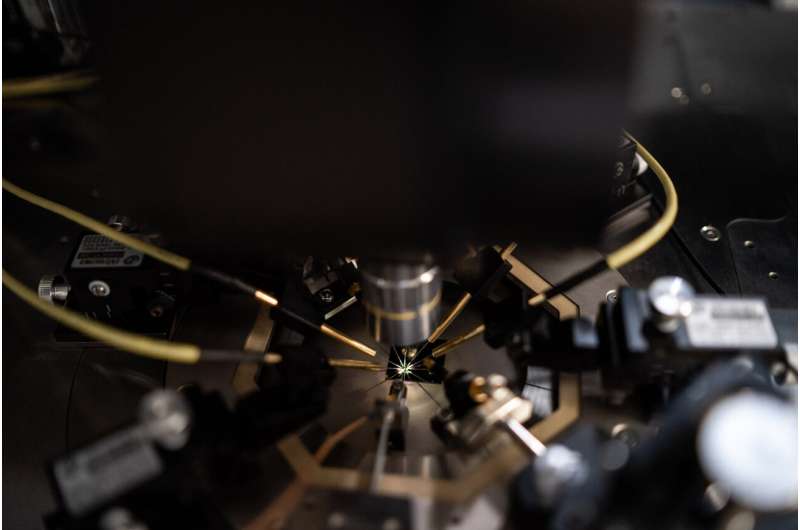

Memristores medidos en una estación de sonda. Crédito: Departamento de Portavoces de Technion.

Si bien los modelos de inteligencia artificial (IA) son cada vez más avanzados, entrenar y ejecutar estos modelos en hardware de computadora convencional consume mucha energía. Por lo tanto, los ingenieros de todo el mundo han estado tratando de crear hardware alternativo inspirado en el cerebro que pueda soportar mejor la alta carga computacional de los sistemas de IA.

Investigadores del Technion-Israel Institute of Technology y el Laboratorio Peng Cheng han creado recientemente un nuevo sistema de computación neuromórfica que admite redes neuronales de creencias profundas (DBN), una clase generativa y gráfica de modelos de aprendizaje profundo. Este sistema, descrito en Naturaleza Electrónicase basa en memristores basados en silicio, dispositivos energéticamente eficientes que pueden almacenar y procesar información.

Los memristores son componentes eléctricos que pueden cambiar o regular el flujo de corriente eléctrica en un circuito, al mismo tiempo que recuerdan la carga que pasó a través de él. Como sus capacidades y estructura se asemejan más a las de las sinapsis del cerebro humano que a las memorias y unidades de procesamiento convencionales, podrían ser más adecuadas para ejecutar modelos de IA.

«Nosotros, como parte de una gran comunidad científica, hemos estado trabajando en computación neuromórfica durante bastante tiempo», dijo a TechXplore Shahar Kvatinsky, uno de los investigadores que llevó a cabo el estudio. «Por lo general, los memristores se usan para realizar cálculos analógicos. Se sabe que existen dos limitaciones principales en el campo neuromórfico: una es la tecnología memristiva que aún no está ampliamente disponible. La segunda es el alto costo de los convertidores que se requieren para convertir el cómputo analógico a los datos digitales y viceversa».

Al desarrollar su sistema informático neuromórfico, Kvatinsky y sus colegas se propusieron superar estas dos limitaciones cruciales de los sistemas basados en memristor. Como los memristores no están ampliamente disponibles, decidieron utilizar en su lugar una tecnología Flash disponible comercialmente desarrollada por Tower Semiconductor, y la diseñaron para que se comportara como un memristor. Además, probaron específicamente su sistema con un DBN de nuevo diseño, ya que este modelo en particular no requiere conversiones de datos (es decir, sus datos de entrada y salida son binarios e inherentemente digitales).

«Las DBN son un antiguo concepto teórico de aprendizaje automático», explicó Kvatinsky. «Nuestra idea era usar neuronas binarias (es decir, con un valor de 0 o 1) (entrada/salida). Hay varias propiedades únicas (en comparación con las redes neuronales profundas), incluido que el entrenamiento de dicha red se basa en calcular la actualización acumulada del modelo deseado y actualizándolo solo cuando alcanza un cierto umbral».

Las sinapsis artificiales creadas por los investigadores se fabricaron utilizando procesos comerciales de semiconductores de óxido de metal complementario (CMOS). Estas sinapsis memristivas basadas en silicio tienen numerosas características ventajosas, que incluyen sintonizabilidad analógica, alta resistencia, tiempo de retención prolongado, degradación cíclica predecible y variabilidad moderada entre diferentes dispositivos.

Kvatinsky y sus colegas demostraron su sistema entrenando un tipo de DBN, conocido como máquina restringida de Boltzmann, en una tarea de reconocimiento de patrones. Para entrenar este modelo (una máquina Boltzmann restringida memristiva de 19×8), utilizaron dos matrices de 12×8 de los memristores que diseñaron.

«La simplicidad de DBN los hace atractivos para la implementación de hardware», dijo Kvatinsky. «Demostramos que, aunque las DBN son fáciles de implementar (debido a su naturaleza binaria), podemos alcanzar una alta precisión (>97 % de reconocimiento preciso de dígitos escritos a mano) cuando usamos memristores basados en Y-Flash».

La arquitectura presentada por este equipo de investigadores ofrece una nueva solución viable para ejecutar máquinas Boltzmann restringidas y otras DBN. En el futuro, podría inspirar el desarrollo de sistemas neuromórficos similares, ayudando colectivamente a ejecutar sistemas de IA de manera más eficiente energéticamente.

«Ahora planeamos ampliar esta arquitectura, explorar tecnologías memristivas adicionales y explorar más arquitecturas de redes neuronales».

Wei Wang et al, Una red neuronal de creencias profundas memristivas basada en sinapsis de silicio, Naturaleza Electrónica (2022). DOI: 10.1038/s41928-022-00878-9

© 2023 Ciencia X Red

Citación: Una red neuronal de creencias profundas basada en sinapsis memristivas de silicio (2023, 11 de enero) consultado el 11 de enero de 2023 de https://techxplore.com/news/2023-01-deep-belief-neural-network-based.html

Este documento está sujeto a derechos de autor. Aparte de cualquier trato justo con fines de estudio o investigación privados, ninguna parte puede reproducirse sin el permiso por escrito. El contenido se proporciona únicamente con fines informativos.