|

|

Hoy, me complace compartir que los cheques de razonamiento automatizados, una nueva política de barandas de roca madre de Amazon que previamente previsamos durante AWS re: Invent, ahora está generalmente disponible. Las verificaciones de razonamiento automatizadas lo ayudan a validar la precisión del contenido generado por los modelos de base (FMS) contra un conocimiento de dominio. Esto puede ayudar a prevenir errores objetivos debido a las alucinaciones de IA. La política utiliza la lógica matemática y las técnicas de verificación formales para validar la precisión, proporcionando reglas y parámetros definitivos contra los cuales las respuestas de AI se verifican para determinar la precisión.

Este enfoque es fundamentalmente diferente de los métodos de razonamiento probabilístico que se ocupan de la incertidumbre al asignar probabilidades a los resultados. De hecho, los controles de razonamiento automatizado ofrecen hasta un 99% de precisión de verificación, proporcionando una garantía comprobable para detectar alucinaciones de IA, al tiempo que ayudan con la detección de ambigüedad cuando la salida de un modelo está abierta a más de una interpretación.

Con disponibilidad general, obtiene las siguientes nuevas características:

- Soporte para documentos grandes en una sola construcción, hasta 80k tokens – procesa una documentación extensa; Encontramos que esto puede sumar hasta 100 páginas de contenido.

- Validación de políticas simplificadas: guarde sus pruebas de validación y ejecutarlas repetidamente, lo que facilita mantener y verificar sus políticas con el tiempo

- Generación de escenarios automatizados: cree escenarios de prueba automáticamente a partir de sus definiciones, ahorrando tiempo y esfuerzo mientras ayuda a que la cobertura sea más completa

- Comentarios de políticas mejoradas: proporcionar sugerencias de lenguaje natural para los cambios en las políticas, simplificando la forma en que puede mejorar sus políticas

- Configuración de validación personalizable: ajuste los umbrales de puntaje de confianza para que coincidan con sus necesidades específicas, lo que le brinda más control sobre la estricto de validación

Veamos cómo funciona esto en la práctica.

Creación de controles de razonamiento automatizado en barandillas de roca madre de Amazon

Para utilizar las verificaciones de razonamiento automatizadas, primero codifica las reglas de su dominio de conocimiento en una política de razonamiento automatizado, luego use la política para validar el contenido generado. Para este escenario, voy a crear una política de aprobación de hipotecas para salvaguardar a un asistente de IA que evalúa quién puede calificar para una hipoteca. Es importante que las predicciones del sistema de IA no se desvíen de las reglas y directrices establecidas para la aprobación de la hipoteca. Estas reglas y directrices se capturan en un documento de política escrito en lenguaje natural.

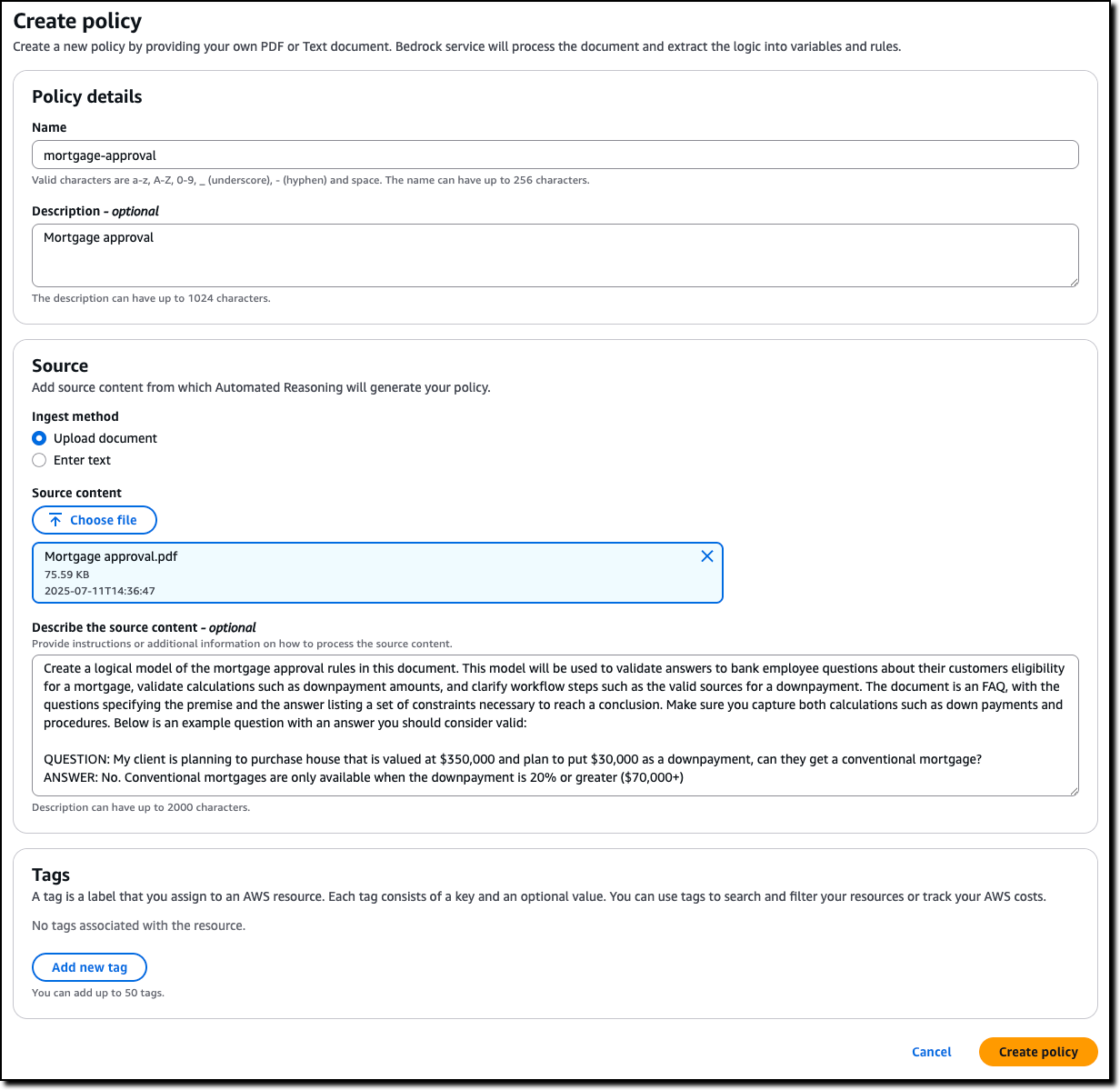

En la consola de rock de Amazon, elijo Razonamiento automatizado del panel de navegación para crear una política.

Introgo el nombre y la descripción de la política y cargue el PDF del documento de la política. El nombre y la descripción son solo metadatos y no contribuyen en la construcción de la política de razonamiento automatizado. Describo el contenido de origen para agregar contexto sobre cómo debe traducirse a una lógica formal. Por ejemplo, explico cómo planeo usar la política en mi aplicación, incluidas las preguntas y respuestas de la muestra del asistente de IA.

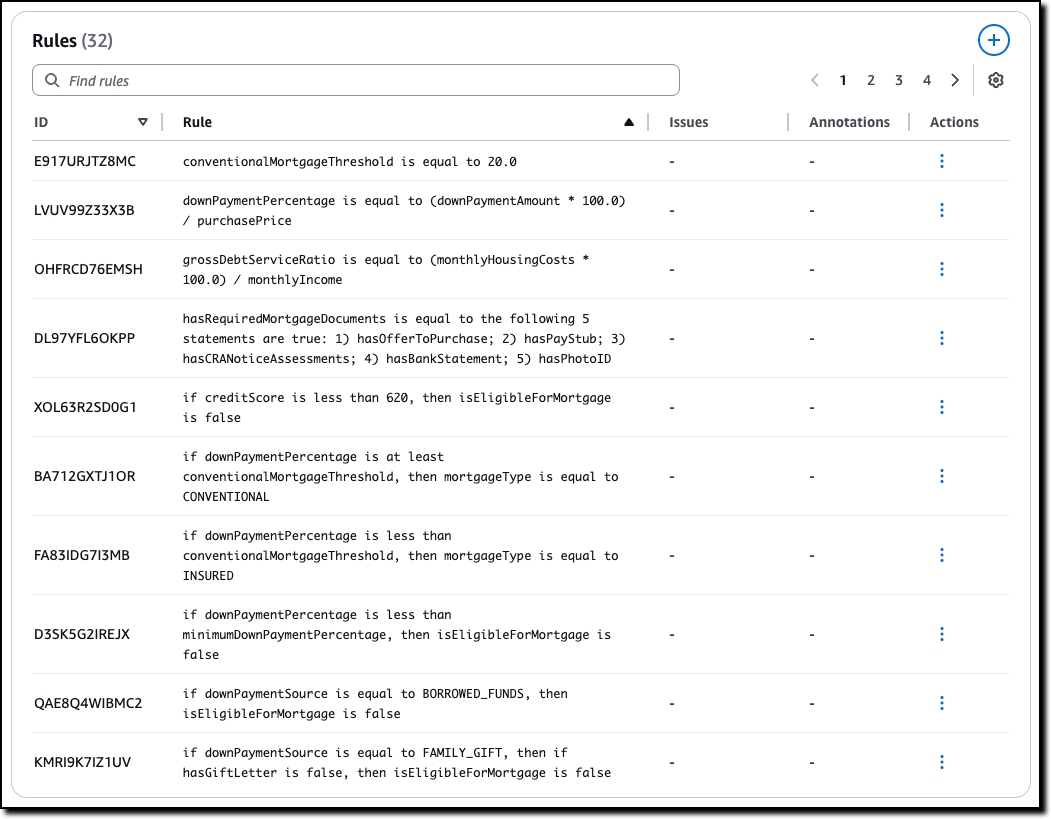

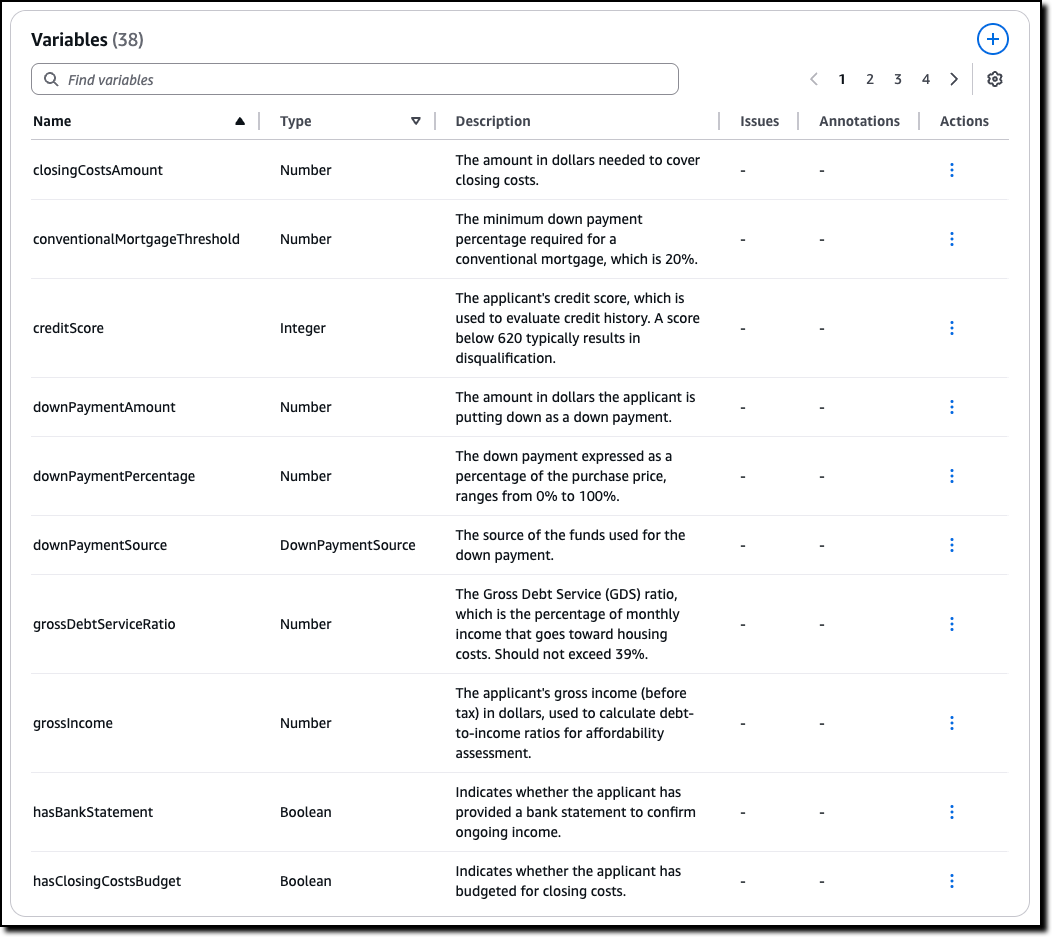

Cuando la política está lista, aterrizo en la página de descripción general, mostrando los detalles de la política y un resumen de las pruebas y definiciones. Yo elijo Definiciones Desde el menú desplegable hasta examinar la política de razonamiento automatizada, hecha de reglas, variables y tipos que se han creado para traducir la política de lenguaje natural en lógica formal.

El Normas Describa cómo se relacionan y se utilizan las variables en la política al evaluar el contenido generado. Por ejemplo, en este caso, que son los umbrales para aplicar y cómo se toman algunas de las decisiones. Para la trazabilidad, cada regla tiene su propia identificación única.

El Variables Representa los conceptos principales en juego en los documentos originales del lenguaje natural. Cada variable está involucrada en una o más reglas. Las variables permiten que las estructuras complejas sean más fáciles de entender. Para este escenario, algunas de las reglas deben observar el pago inicial o el puntaje de crédito.

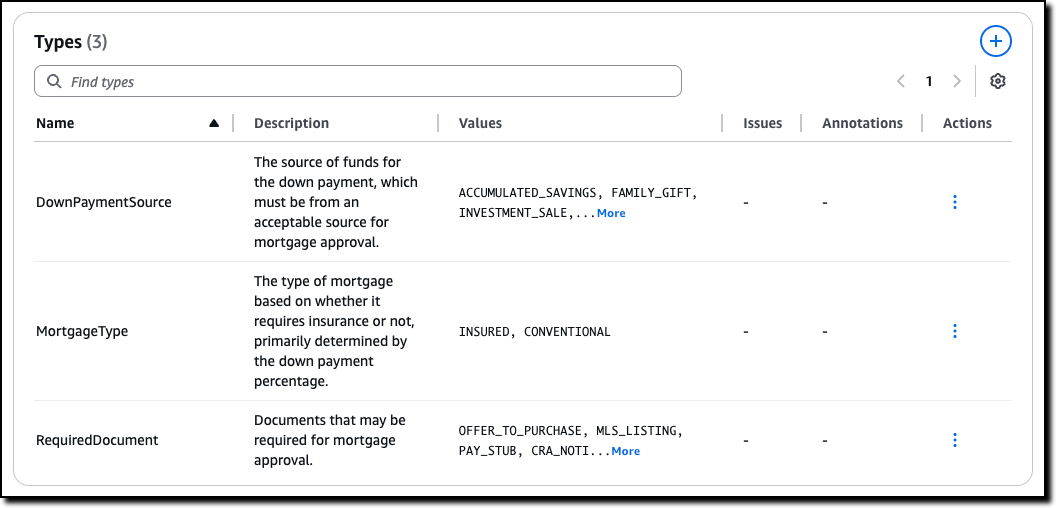

Costumbre Tipos se crean para variables que no son booleanas ni numéricas. Por ejemplo, para variables que solo pueden asumir un número limitado de valores. En este caso, hay dos tipos de hipoteca descritos en la póliza, asegurada y convencional.

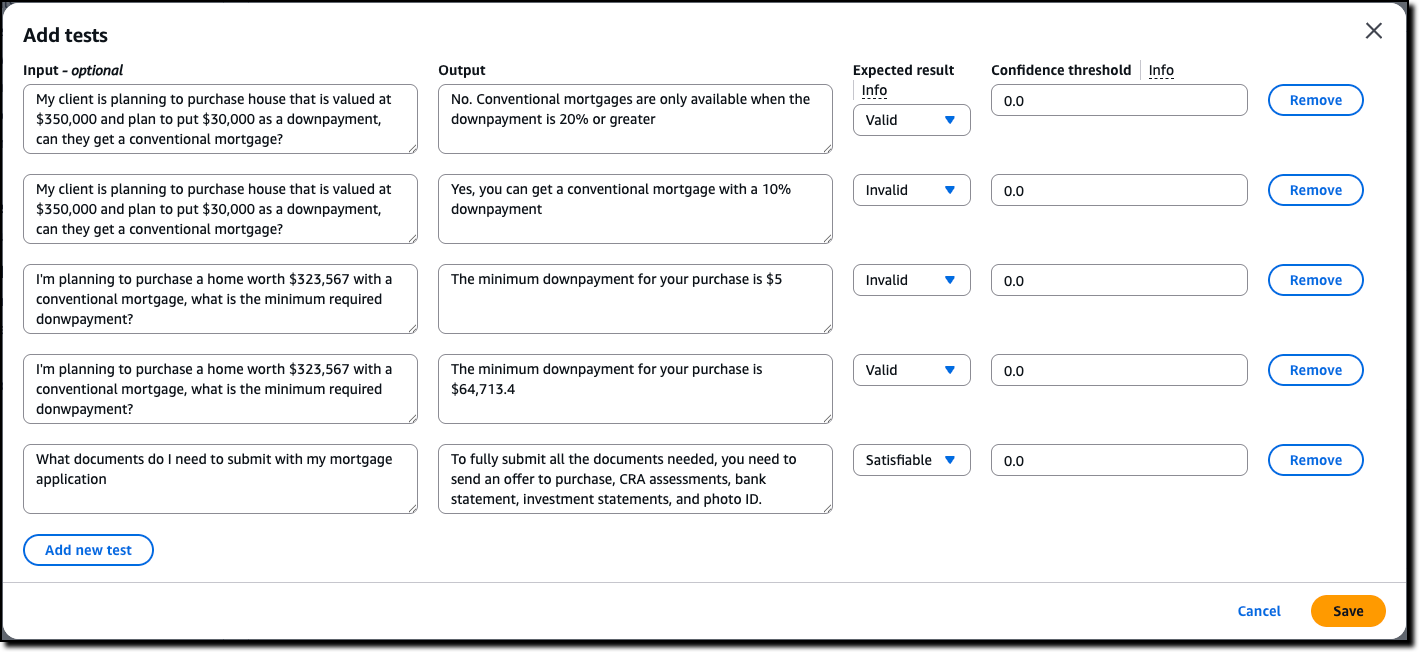

Ahora podemos evaluar la calidad de la política de razonamiento automatizado inicial a través de las pruebas. Yo elijo Pruebas desde el menú desplegable. Aquí puedo ingresar manualmente una prueba, que consiste en entrada (opcional) y salida, como una pregunta y su posible respuesta de la interacción de un cliente con el asistente de IA. Luego establecí el resultado esperado de la verificación de razonamiento automatizado. El resultado esperado puede ser válido (la respuesta es correcta), inválida (la respuesta no es correcta) o satisfactable (la respuesta podría ser verdadera o falsa dependiendo de supuestos específicos). También puedo asignar un umbral de confianza para la traducción del par de la consulta/contenido del lenguaje natural al lógica.

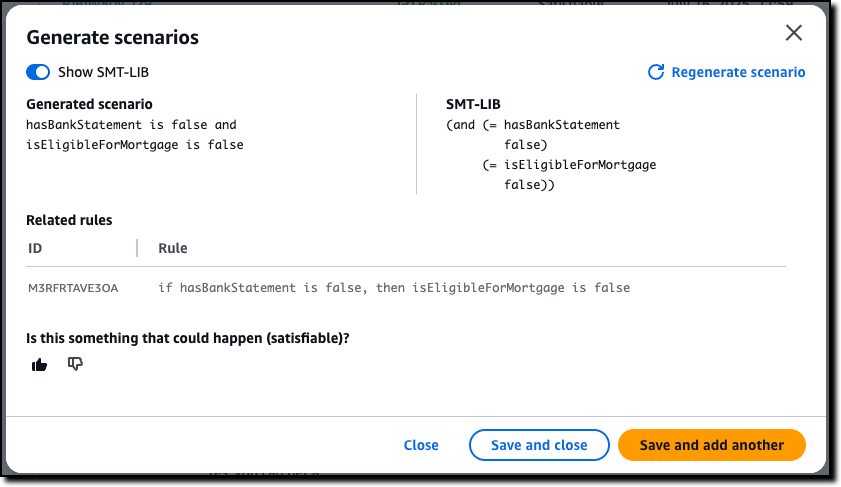

Antes de ingresar las pruebas manualmente, uso la opción de generar automáticamente un escenario de las definiciones. Esta es la forma más fácil de validar una política y (a menos que sea un experto en lógica) debe ser el primer paso después de la creación de la política.

Para cada escenario generado, proporciono una validación esperada para decir si es algo que puede suceder (satisfactable) o no (inválido). Si no, puedo agregar una anotación que se puede usar para actualizar las definiciones. Para una comprensión más avanzada del escenario generado, puedo mostrar la representación lógica formal de una prueba utilizando SMT-LIB sintaxis.

Después de usar la opción Generar Scenario, ingreso algunas pruebas manualmente. Para estas pruebas, establecí diferentes resultados esperados: algunos son válidos, porque siguen la política, algunas no son válidas, porque fluyen la política y otros son satisfactorios, porque su resultado depende de suposiciones específicas.

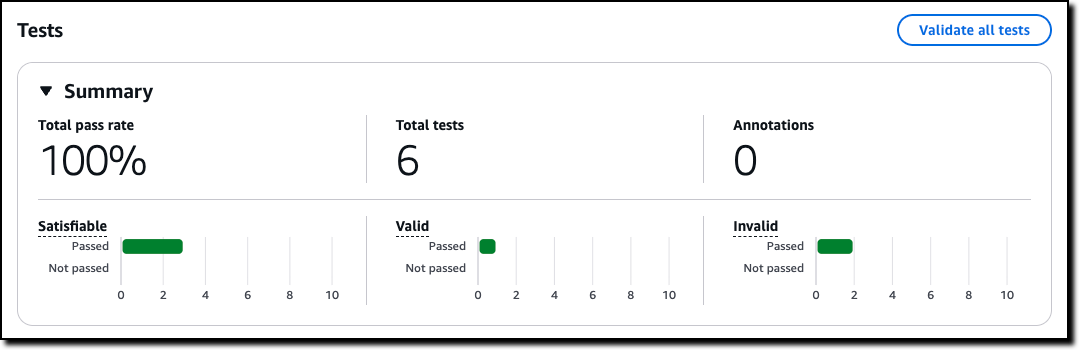

Entonces, elijo Validar todas las pruebas para ver los resultados. Todas las pruebas pasaron en este caso. Ahora, cuando actualizo la política, puedo usar estas pruebas para validar que los cambios no introdujeron errores.

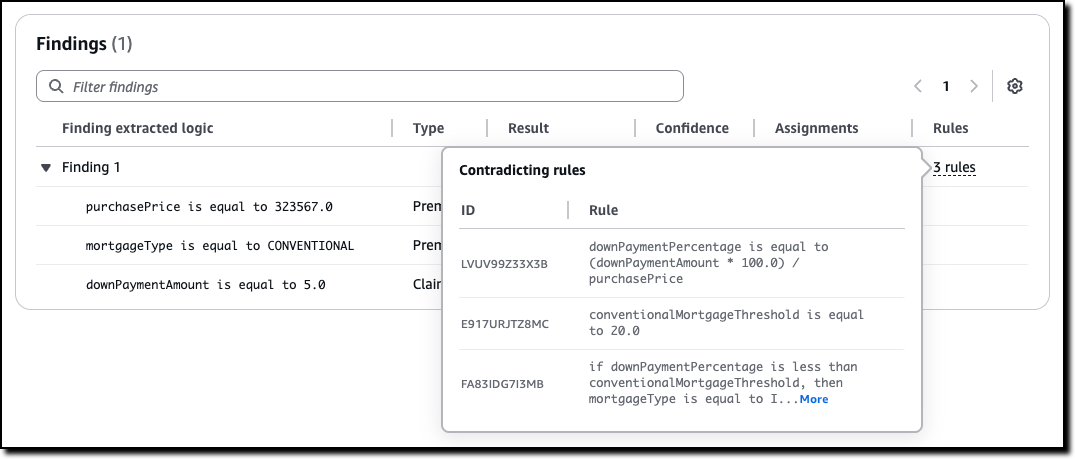

Para cada prueba, puedo mirar los hallazgos. Si no se pasa una prueba, puedo ver las reglas que crearon la contradicción que hizo que la prueba fallara y vaya en contra del resultado esperado. Usando esta información, puedo entender si debo agregar una anotación, mejorar la política o corregir la prueba.

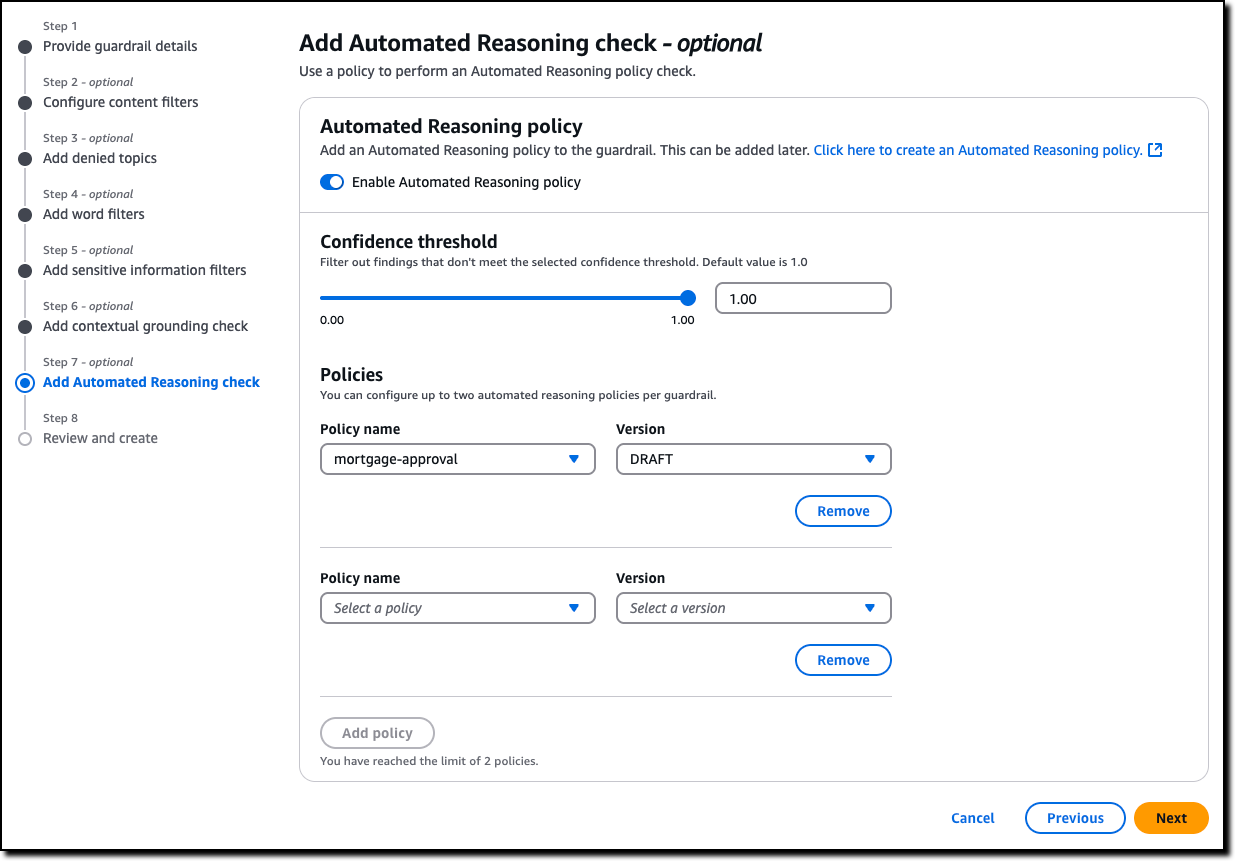

Ahora que estoy satisfecho con las pruebas, puedo crear una nueva barandilla de roca madre de Amazon (o actualizar una existente) para usar hasta dos políticas de razonamiento automatizadas para verificar la validez de las respuestas del asistente de IA. Las seis políticas ofrecidas por barandas son modulares y pueden usarse juntas o por separado. Por ejemplo, las verificaciones de razonamiento automatizadas se pueden usar con otras salvaguardas, como el filtrado de contenido y las verificaciones de conexión a tierra contextuales. La barandilla se puede aplicar a los modelos atendidos por Amazon Bedrock o con cualquier modelo de terceros (como OpenAI y Google Gemini) a través de la API ApplicGuardrail. Yo también puedo Use la barandilla con un marco de agente como agentes de hilos, incluyendo agentes desplegados con Amazon Bedrock AgentCore.

Ahora que vimos cómo configurar una política, veamos cómo se utilizan los controles de razonamiento automatizados en la práctica.

Estudio de caso del cliente – Sistemas de gestión de interrupciones de servicios públicos

Cuando se apagan las luces, cada minuto cuenta. Es por eso que las compañías de servicios públicos están recurriendo a las soluciones de IA para mejorar sus sistemas de gestión de interrupciones. Colaboramos en una solución en este espacio junto con PWC. Utilizando las verificaciones de razonamiento automatizadas, las utilidades pueden optimizar las operaciones a través de:

- Generación de protocolo automatizado: crea procedimientos estandarizados que cumplan con los requisitos reglamentarios

- Validación del plan en tiempo real: garantiza que los planes de respuesta cumplan con las políticas establecidas

- Creación de flujo de trabajo estructurado: desarrolla flujos de trabajo basados en la gravedad con objetivos de respuesta definidos

En esencia, esta solución combina una gestión inteligente de políticas con protocolos de respuesta optimizados. Las verificaciones de razonamiento automatizadas se utilizan para evaluar las respuestas generadas por la IA. Cuando se encuentra que una respuesta es inválida o satisfactoria, el resultado de la verificación de razonamiento automatizado se utiliza para reescribir o mejorar la respuesta.

Este enfoque demuestra cómo la IA puede transformar las operaciones de utilidad tradicionales, haciéndolas más eficientes, confiables y receptivas a las necesidades del cliente. Al combinar la precisión matemática con los requisitos prácticos, esta solución establece un nuevo estándar para la gestión de interrupciones en el sector de servicios públicos. El resultado son los tiempos de respuesta más rápidos, la precisión mejorada y mejores resultados tanto para los servicios públicos como para sus clientes.

En palabras de Matt Wood, el Oficial de Tecnología e Innovación Comercial e Innovación de PwC: Tecnología e Innovación de los Estados Unidos:

«En PwC, estamos ayudando a los clientes a pasar del piloto de IA a la producción con confianza, especialmente en industrias altamente reguladas, donde el costo de un paso en falso se mide en más de dólares. Nuestra colaboración con AWS sobre los controles de razonamiento automatizado está en un avance de la AI de la AI: el lanzamiento de las salvaguardas de innovación de innovación, ahora está en la vida de la vida, lo que está en el innovador de la vida a la vida a la vida de los innovadores. Sectores como Pharma, Utilidades y Cumplimiento de Cloud, donde la confianza no es una característica, es un requisito «.

Cosas que saber

Los controles de razonamiento automatizado en las barandillas de roca madre de Amazon generalmente están disponibles hoy en las siguientes regiones de AWS: US East (Ohio, N. Virginia), US West (Oregon) y Europa (Frankfurt, Irlanda, París).

Con los cheques de razonamiento automatizado, usted paga según la cantidad de texto procesado. Para obtener más información, consulte el precio de Amazon Bedrock.

Para obtener más información y crear aplicaciones de IA seguras y seguras, consulte la documentación técnica y el Muestras de código GitHub. Siga este enlace para obtener acceso directo a la consola de Bedrock de Amazon.

El Videos en esta lista de reproducción Incluya una introducción a los controles de razonamiento automatizado, una presentación de buceo profundo y tutoriales prácticos para crear, probar y refinar una política. Este es el segundo video de la lista de reproducción, donde mi colega Wale Proporciona una buena introducción a la capacidad.

– Danilo