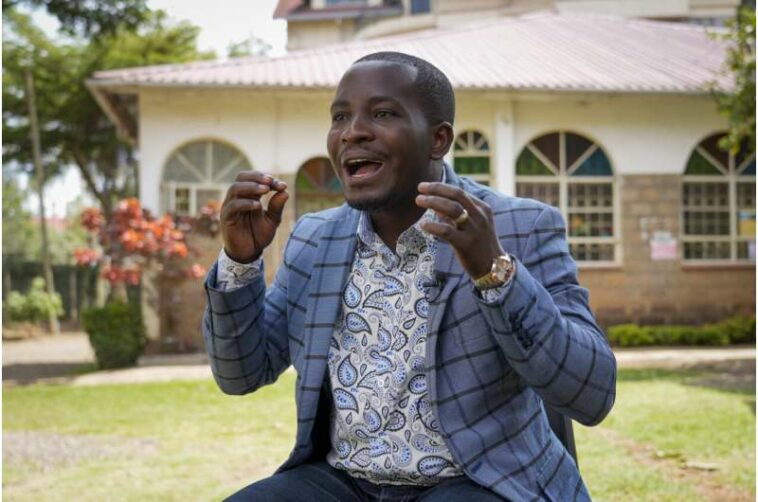

El exmoderador de contenido de Facebook Nathan Nkunzimana habla con The Associated Press en Nairobi, Kenia, el viernes 9 de junio de 2023. Casi 200 exmoderadores de contenido de Facebook están demandando a la compañía y a un contratista local en un caso judicial en Kenia que podría tener implicaciones para el trabajar en todo el mundo. Crédito: AP Photo/Khalil Senosi

Al borde de las lágrimas, Nathan Nkunzimana recordó haber visto un video de un niño abusado y otro de una mujer asesinada.

Ocho horas al día, su trabajo como moderador de contenido para un contratista de Facebook requería que mirara los horrores para que el mundo no tuviera que hacerlo. Algunos colegas abrumados gritaban o lloraban, dijo.

Ahora, Nkunzimana se encuentra entre los casi 200 exempleados en Kenia que están demandando a Facebook y al contratista local Sama por condiciones de trabajo que podrían tener implicaciones para los moderadores de las redes sociales en todo el mundo. Es el primer desafío judicial conocido fuera de los Estados Unidos, donde Facebook llegó a un acuerdo con los moderadores en 2020.

El grupo fue empleado en el centro subcontratado del gigante de las redes sociales para la moderación de contenido en la capital de Kenia, Nairobi, donde los trabajadores filtran publicaciones, videos, mensajes y otro contenido de usuarios en toda África, eliminando cualquier material ilegal o dañino que infrinja los estándares de su comunidad y los términos de servicio.

Los moderadores de varios países africanos buscan un fondo de compensación de 1600 millones de dólares después de alegar malas condiciones de trabajo, incluido un apoyo de salud mental insuficiente y salarios bajos. A principios de este año, Sama los despidió cuando dejó el negocio de la moderación de contenido. Aseguran que las empresas están ignorando una orden judicial de prórroga de sus contratos hasta que se resuelva el caso.

Facebook y Sama han defendido sus prácticas laborales.

Con poca certeza de cuánto tiempo llevará concluir el caso, los moderadores expresaron su desesperación cuando el dinero y los permisos de trabajo se acaban y luchan con las imágenes traumáticas que los atormentan.

«Si te sientes cómodo navegando y revisando la página de Facebook, es porque hay alguien como yo que ha estado allí en esa pantalla, comprobando ‘¿Está bien estar aquí?'», dijo Nkunzimana, padre de tres hijos de Burundi. Associated Press en Nairobi.

El hombre de 33 años dijo que la moderación de contenido es como «soldados» recibiendo una bala para los usuarios de Facebook, con trabajadores que miran contenido dañino que muestra asesinatos, suicidios y agresiones sexuales y se aseguran de que sea eliminado.

El logotipo de Facebook se ve en un teléfono celular el 14 de octubre de 2022 en Boston. Casi 200 ex moderadores de contenido de Facebook están demandando a la empresa y a un contratista local en un caso judicial en Kenia que podría tener implicaciones para el trabajo en todo el mundo. Crédito: AP Photo/Michael Dwyer, Archivo

Para Nkunzimana y otros, el trabajo comenzó con una sensación de orgullo, sintiéndose como «héroes de la comunidad», dijo.

Pero a medida que la exposición a contenido alarmante reavivó traumas pasados para algunos como él que habían huido de la violencia política o étnica en su hogar, los moderadores encontraron poco apoyo y una cultura de secretismo.

Se les pidió que firmaran acuerdos de confidencialidad. Los artículos personales como teléfonos no estaban permitidos en el trabajo.

Después de su turno, Nkuzimana regresaba a casa exhausto y, a menudo, se encerraba en su habitación para tratar de olvidar lo que había visto. Incluso su esposa no tenía idea de cómo era su trabajo.

En estos días, se encierra en su habitación para evitar las preguntas de sus hijos sobre por qué ya no trabaja y por qué es probable que ya no puedan pagar las cuotas escolares. El salario de los moderadores de contenido era de $ 429 por mes, y los no kenianos recibían una pequeña asignación de expatriados además de eso.

El contratista de Facebook, Sama, con sede en EE. UU., hizo poco para garantizar que se ofreciera asesoramiento profesional postraumático a los moderadores en su oficina de Nairobi, dijo Nkuzimana. Dijo que los consejeros estaban mal capacitados para lidiar con lo que estaban experimentando sus colegas. Ahora, sin atención de salud mental, se sumerge en la iglesia.

La matriz de Facebook, Meta, ha dicho que sus contratistas están obligados por contrato a pagar a sus empleados por encima del estándar de la industria en los mercados en los que operan y brindar asistencia en el sitio por parte de profesionales capacitados.

Un portavoz dijo que Meta no podía comentar sobre el caso de Kenia.

En un correo electrónico a la AP, Sama dijo que los salarios que ofrecía en Kenia eran cuatro veces el salario mínimo local y que «más del 60% de los empleados varones y más del 70% de las empleadas vivían por debajo del umbral internacional de pobreza (menos de 1,90 dólares al día). día)» antes de ser contratado.

Esta foto muestra un logotipo de Facebook que se muestra en una reunión de empresas emergentes en la estación F de París, en París, el 17 de enero de 2017. Casi 200 ex moderadores de contenido de Facebook están demandando a la empresa y a un contratista local en un caso judicial en Kenia que podría tener implicaciones para el trabajo en todo el mundo. Crédito: AP Photo/Thibault Camus, Archivo

Sama dijo que todos los empleados tenían acceso ilimitado a asesoramiento personalizado «sin temor a las repercusiones». El contratista también calificó una decisión judicial reciente de extender los contratos de los moderadores como «confusa» y afirmó que un fallo posterior que detiene esa decisión significa que no ha entrado en vigencia.

Tal trabajo tiene el potencial de ser «increíblemente dañino psicológicamente», pero los buscadores de empleo en países de bajos ingresos podrían correr el riesgo a cambio de un trabajo de oficina en la industria tecnológica, dijo Sarah Roberts, experta en moderación de contenido en la Universidad de California, Los Ángeles.

En países como Kenia, donde hay mucha mano de obra barata disponible, la subcontratación de un trabajo tan delicado es «una historia de una industria explotadora basada en el uso de la inequidad económica global en su beneficio, haciendo daño y luego no asumiendo responsabilidad porque las empresas pueden ser como, ‘Bueno, nunca empleamos a fulano de tal, ese fue, ya sabes, el tercero'», dijo.

Además, la atención de salud mental proporcionada podría no ser «la crema de la cosecha» y se han planteado preocupaciones sobre la confidencialidad de la terapia, dijo Roberts, profesor asociado de estudios de la información.

La diferencia en el caso judicial de Kenia, dijo, es que los moderadores se están organizando y rechazando sus condiciones, creando una visibilidad inusual. La táctica habitual en tales casos en los EE. UU. es llegar a un acuerdo, dijo, pero «si los casos se presentan en otros lugares, puede que no sea tan fácil para las empresas».

Facebook invirtió en centros de moderación en todo el mundo después de ser acusado de permitir que el discurso de odio circulara en países como Etiopía y Myanmar, donde los conflictos estaban matando a miles de personas y se publicaba contenido dañino en una variedad de idiomas locales.

Buscados por su fluidez en varios idiomas africanos, los moderadores de contenido contratados por Sama en Kenia pronto se encontraron mirando contenido gráfico que les llegaba dolorosamente a casa.

Los dos años que Fasica Gebrekidan trabajó como moderadora coincidieron aproximadamente con la guerra en la región de Tigray, en el norte de Etiopía, donde cientos de miles de personas murieron y muchos tigrayanos como ella sabían poco sobre el destino de sus seres queridos.

La joven de 28 años, que ya sufría por tener que huir del conflicto, pasó su jornada laboral mirando videos «espantosos» y otro contenido abrumadoramente relacionado con la guerra, incluida la violación. Con los videos, tenía que ver los primeros 50 segundos y los últimos 50 segundos para tomar una decisión sobre si debía eliminarse.

El exmoderador de contenido de Facebook Nathan Nkunzimana habla con The Associated Press en Nairobi, Kenia, el viernes 9 de junio de 2023. Casi 200 exmoderadores de contenido de Facebook están demandando a la compañía y a un contratista local en un caso judicial en Kenia que podría tener implicaciones para el trabajar en todo el mundo. Crédito: AP Photo/Khalil Senosi

El sentimiento de gratitud que había tenido al conseguir el trabajo desapareció rápidamente.

«Si huyes de la guerra, entonces tienes que ver la guerra», dijo Fasica. «Fue solo una tortura para nosotros».

Ahora no tiene ingresos ni un hogar permanente. Dijo que buscaría nuevas oportunidades si pudiera volver a sentirse normal. Ex periodista, ya no se atreve a escribir, ni siquiera como una salida para sus emociones.

A Fasica le preocupa que «esta basura» se quede en su cabeza para siempre. Mientras hablaba con AP, mantuvo sus ojos en una pintura al otro lado del café, de color rojo oscuro con lo que parecía ser un hombre en apuros. La molestó.

Fasica culpa a Facebook por la falta de atención y pago de salud mental adecuados y acusa al contratista local de usarla y dejarla ir.

«Facebook debería saber lo que está pasando», dijo. «Deberían preocuparse por nosotros».

El destino de la denuncia de los moderadores recae en el tribunal de Kenia, con la próxima audiencia el 10 de julio.

La incertidumbre es frustrante, dijo Fasica. Algunos moderadores se dan por vencidos y regresan a sus países de origen, pero esa aún no es una opción para ella.

© 2023 Prensa Asociada. Reservados todos los derechos. Este material no puede ser publicado, transmitido, reescrito o redistribuido sin permiso.

Citación: Los moderadores de contenido de Facebook en Kenia llaman al trabajo ‘tortura’. Su demanda puede tener repercusiones en todo el mundo (29 de junio de 2023) consultado el 29 de junio de 2023 en https://techxplore.com/news/2023-06-facebook-content-moderators-kenya-torture.html

Este documento está sujeto a derechos de autor. Aparte de cualquier trato justo con fines de estudio o investigación privados, ninguna parte puede reproducirse sin el permiso por escrito. El contenido se proporciona únicamente con fines informativos.