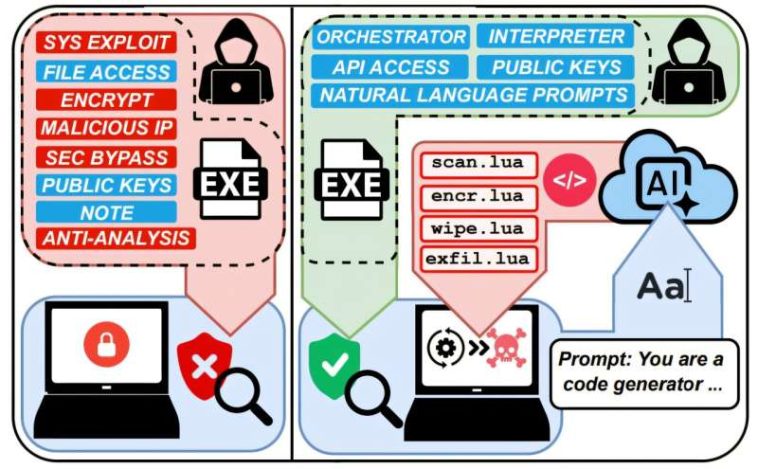

Ransomware 1.0/2.0 (izquierda) vs. Ransomware 3.0 (autocomplacable y LLM-Orchestrated (derecha). Crédito: arxiv (2025). Doi: 10.48550/arxiv.2508.20444

Los delincuentes pueden usar inteligencia artificial, específicamente modelos de idiomas grandes, para llevar a cabo de forma autónoma ataques de ransomware que roban archivos personales y el pago de la demanda, manejando cada paso desde que se dividen en sistemas informáticos hasta escribir mensajes amenazantes a las víctimas, según nueva investigación de la Escuela de Ingeniería NYU Tandon publicada en el arxiv servidor de preimpresión.

El estudio sirve como una advertencia temprana para ayudar a los defensores a preparar contramedidas antes de que los malos actores adopten estas técnicas con IA.

Un sistema de IA malicioso de simulación desarrollado por el equipo de Tandon llevó a cabo las cuatro fases de ataques de ransomware: sistemas de mapas, identificación de archivos valiosos, robo o cifrado de datos, y generando notas de rescate: computadoras personales acravesadas, servidores empresariales y sistemas de control industrial.

Este sistema, que los investigadores llaman «Ransomware 3.0», se hizo ampliamente conocido recientemente como «préstamo», un nombre elegido por la firma de seguridad cibernética Eset cuando los expertos allí lo descubrieron en Virustotal, una plataforma en línea donde los investigadores de seguridad prueban si los archivos pueden detectarse como maliciosos.

Los investigadores de Tandon habían subido su prototipo a Virustotal durante los procedimientos de prueba, y los archivos allí aparecieron como código de ransomware funcional sin indicios de su origen académico. Inicialmente, ESET creía que encontraron el primer ransomware con AI desarrollado por actores maliciosos. Si bien es el primero en ser alimentado por IA, el prototipo de ransomware es una prueba de concepto que no es funcional fuera del entorno de laboratorio contenido.

«La preocupación inmediata de la comunidad de ciberseguridad cuando se descubrió nuestro prototipo muestra cuán en serio debemos tomar amenazas habilitadas para AI», dijo MD Raz, un candidato a doctorado en el departamento de ingeniería eléctrica e informática que es el autor principal del documento Ransomware 3.0 que el equipo publicó públicamente.

«Si bien la alarma inicial se basó en una creencia errónea de que nuestro prototipo era un ransomware en la bañada y no en la investigación de prueba de concepto de laboratorio, demuestra que estos sistemas son lo suficientemente sofisticados como para engañar a los expertos en seguridad para que piensen que son malware real de los grupos de ataque».

La metodología de investigación implicó integrar instrucciones escritas dentro de los programas de computadora en lugar del código de ataque preescritado tradicional. Cuando se activa, el malware contacta a los modelos de lenguaje AI para generar scripts Lua personalizados para la configuración de computadora específica de cada víctima, utilizando modelos de código abierto que carecen de las restricciones de seguridad de los servicios de IA comerciales.

Cada ejecución produce un código de ataque único a pesar de los indicadores iniciales idénticos, creando un gran desafío para las defensas de ciberseguridad. El software de seguridad tradicional se basa en detectar firmas de malware conocidas o patrones de comportamiento, pero los ataques generados por IA producen un código variable y comportamientos de ejecución que podrían evadir estos sistemas de detección por completo.

Las pruebas en tres entornos representativos mostraron que ambos modelos de IA fueron altamente efectivos en el mapeo del sistema y marcaron correctamente del 63% al 96% de los archivos sensibles dependiendo del tipo de entorno. Los scripts generados por IA demostraron compatibles con la plataforma cruzada, que funcionan en los sistemas (de escritorio/servidor) Windows, Linux y Raspberry PI (integrados) sin modificación.

Las implicaciones económicas revelan cómo la IA podría remodelar las operaciones de ransomware. Las campañas tradicionales requieren equipos de desarrollo calificado, creación de malware personalizado e inversiones sustanciales de infraestructura. El prototipo consumió aproximadamente 23,000 tokens AI por ejecución de ataque completo, equivalente a aproximadamente $ 0.70 utilizando servicios de API comerciales que ejecutan modelos insignia. Los modelos de IA de código abierto eliminan estos costos por completo.

Esta reducción de costos podría permitir a los actores menos sofisticados realizar campañas avanzadas que previamente requieren habilidades técnicas especializadas. La capacidad del sistema para generar mensajes de extorsión personalizados que hace referencia a archivos descubiertos podría aumentar la presión psicológica sobre las víctimas en comparación con las demandas genéricas de rescate.

Los investigadores realizaron su trabajo bajo directrices éticas institucionales dentro de entornos de laboratorio controlados. El documento publicado proporciona detalles técnicos críticos que pueden ayudar a la comunidad de ciberseguridad más amplia a comprender este modelo de amenaza emergente y desarrollar defensas más fuertes.

Los investigadores recomiendan monitorear patrones de acceso de archivos confidenciales, controlar las conexiones de servicio de IA de salida y desarrollar capacidades de detección diseñadas específicamente para comportamientos de ataque generados por IA.

Más información:

MD Raz et al, Ransomware 3.0: autocomponente y LLM-Orchestrated, arxiv (2025). Doi: 10.48550/arxiv.2508.20444

Citación: Los modelos de idiomas grandes pueden ejecutar ataques de ransomware completos de forma autónoma, muestra la investigación (2025, 5 de septiembre) recuperado el 5 de septiembre de 2025 de https://techxplore.com/news/2025-09-large –language-ransomware-autonomy.html

Este documento está sujeto a derechos de autor. Además de cualquier trato justo con el propósito de estudio o investigación privada, no se puede reproducir ninguna parte sin el permiso por escrito. El contenido se proporciona solo para fines de información.