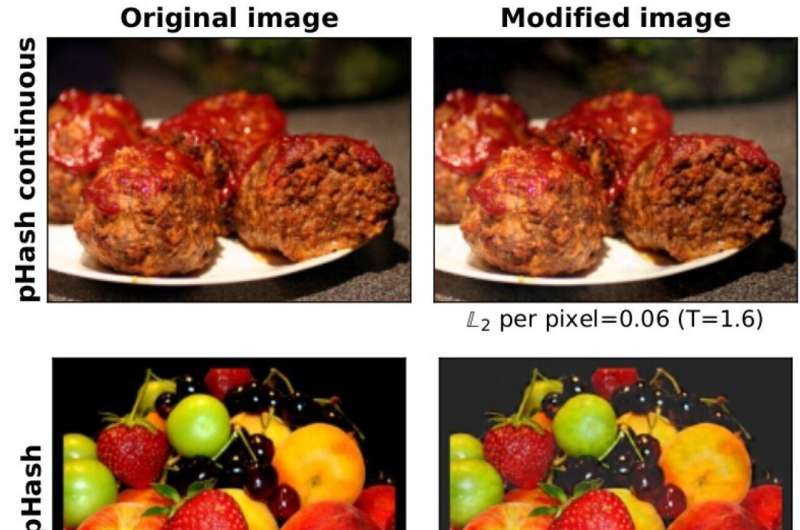

Estas imágenes se han codificado para que se vean diferentes a los algoritmos de detección, pero casi idénticas a nosotros. Crédito: Imperial College London

Los algoritmos propuestos que detectan imágenes ilegales en dispositivos pueden engañarse fácilmente con cambios imperceptibles en las imágenes, según ha descubierto la investigación de Imperial.

Las empresas y los gobiernos han propuesto el uso de escáneres integrados en dispositivos como teléfonos, tabletas y computadoras portátiles para detectar imágenes ilegales, como material de abuso sexual infantil (CSAM). Sin embargo, los nuevos hallazgos del Imperial College de Londres plantean dudas sobre qué tan bien podrían funcionar estos escáneres en la práctica.

Los investigadores que probaron la solidez de cinco algoritmos similares encontraron que alterar la ‘firma’ única de una imagen ‘ilegal’ en un dispositivo significaba que volaría bajo el radar del algoritmo el 99,9 por ciento de las veces.

Los científicos detrás del estudio revisado por pares dicen que sus pruebas demuestran que en su forma actual, los llamados algoritmos de escaneo del lado del cliente basados en hash perceptual (PH-CSS) no serán una ‘solución mágica’ para detectar contenido ilegal como CSAM en personal dispositivos. También plantea serias dudas sobre cuán efectivos y, por lo tanto, proporcionales, son realmente los planes actuales para abordar el material ilegal a través del escaneo en el dispositivo.

Los hallazgos se publican como parte de la Conferencia de seguridad de USENIX en Boston, EE. UU.

El autor principal, el Dr. Yves-Alexandre de Montjoye, del Departamento de Computación y Instituto de Ciencia de Datos de Imperial, dijo: «Simplemente aplicando un filtro diseñado específicamente, casi imperceptible para el ojo humano, engañamos al algoritmo haciéndolo pensar que dos imágenes casi idénticas eran Es importante destacar que nuestro algoritmo es capaz de generar una gran cantidad de filtros diversos, lo que dificulta el desarrollo de contramedidas.

«Nuestros hallazgos plantean serias dudas sobre la solidez de estos enfoques invasivos».

Apple propuso recientemente, y luego pospuso debido a preocupaciones de privacidad, planes para introducir PH-CSS en todos sus dispositivos personales. También hay informes de que ciertos gobiernos están considerando el uso de PH-CSS como una técnica de aplicación de la ley al pasar cifrado de extremo a extremo.

Bajo el radar

Los algoritmos PH-CSS pueden integrarse en dispositivos para buscar material ilegal. Los algoritmos examinan las imágenes de un dispositivo y comparan sus firmas con las de material ilegal conocido. Al encontrar una imagen que coincida con una imagen ilegal conocida, el dispositivo informaría silenciosamente esto a la empresa detrás del algoritmo y, en última instancia, a las autoridades policiales.

Para probar la solidez de los algoritmos, los investigadores utilizaron una nueva clase de pruebas llamadas ataques de detección de evasión para ver si la aplicación de su filtro a imágenes «ilegales» simuladas les permitiría pasar por debajo del radar de PH-CSS y evitar la detección. Sus filtros específicos de imagen están diseñados para garantizar que la imagen evite la detección incluso cuando el atacante no sabe cómo funciona el algoritmo.

Etiquetaron varias imágenes cotidianas como ‘ilegales’ y las alimentaron a través de los algoritmos, que eran similares a los sistemas propuestos por Apple, y midieron si marcaban una imagen como ilegal o no. Luego aplicaron un filtro visualmente imperceptible a las firmas de las imágenes y las volvieron a pasar.

Después de aplicar un filtro, la imagen se veía diferente al algoritmo el 99,9 por ciento de las veces, a pesar de que se veían casi idénticas al ojo humano.

Los investigadores dicen que esto resalta la facilidad con la que las personas con material ilegal pueden engañar a la vigilancia. Por esta razón, el equipo ha decidido no hacer público su software de generación de filtros.

La coautora principal Ana-Maria Cretu, Ph.D. candidato en el Departamento de Computación, dijo: «Dos imágenes que nos parecen iguales pueden verse completamente diferentes para una computadora. Nuestro trabajo como científicos es probar si los algoritmos que preservan la privacidad realmente hacen lo que sus defensores afirman que hacen.

«Nuestros hallazgos sugieren que, en su forma actual, PH-CCS no será la solución mágica que algunos esperan».

El coautor principal Shubham Jain, también Ph.D. El candidato del Departamento de Computación agregó: «Esta constatación, combinada con las preocupaciones de privacidad asociadas a estos mecanismos de vigilancia invasivos, sugiere que incluso las mejores propuestas de PH-CSS de hoy no están listas para su implementación».

«Ataques de evitación de detección de adversarios: evaluación de la solidez del escaneo del lado del cliente basado en hash perceptivo» por Shubham Jain, Ana-Maria Cretu e Yves-Alexandre de Montjoye. Publicado el 9 de noviembre de 2021 como parte de la Conferencia de seguridad de USENIX en Boston, EE. UU.

Apple puede escanear sus fotos en busca de abuso infantil y aún así proteger su privacidad

Shubham Jain, Ana-Maria Cretu, Yves-Alexandre de Montjoye, Ataques de evitación de detección de adversarios: evaluación de la solidez del escaneo del lado del cliente basado en hash perceptual. arXiv: 2106.09820v1 [cs.CR], arxiv.org/abs/2106.09820

Citación: Los detectores de imágenes ilegales propuestos en los dispositivos se ‘engañan fácilmente’ (2021, 9 de noviembre) recuperado el 9 de noviembre de 2021 de https://techxplore.com/news/2021-11-illegal-image-detectors-devices-easily.html

Este documento está sujeto a derechos de autor. Aparte de cualquier trato justo con fines de estudio o investigación privados, no se puede reproducir ninguna parte sin el permiso por escrito. El contenido se proporciona únicamente con fines informativos.