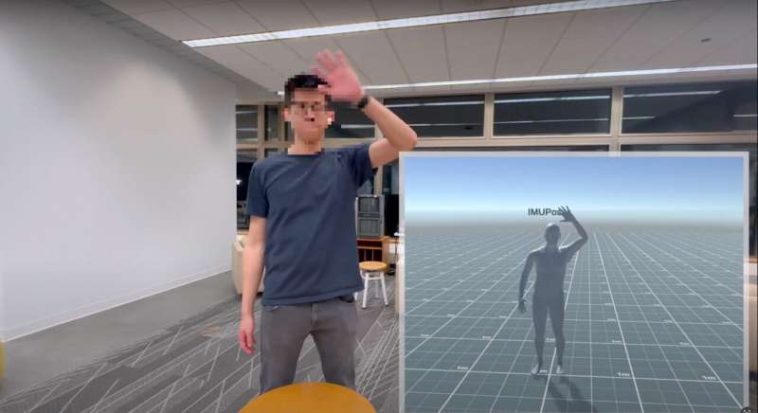

MobilePoser puede realizar estimaciones de poses de cuerpo completo en tiempo real y traducciones humanas en 3D utilizando IMU en dispositivos móviles de consumo. Crédito: Karan Ahuja/Universidad Northwestern

Los ingenieros de la Universidad Northwestern han desarrollado un nuevo sistema para capturar el movimiento de todo el cuerpo, y no requiere salas especializadas, equipos costosos, cámaras voluminosas o una variedad de sensores.

En cambio, requiere un simple dispositivo móvil.

Llamado MobilePoser, el nuevo sistema aprovecha sensores ya integrados en los dispositivos móviles de consumo, incluidos teléfonos inteligentes, relojes inteligentes y auriculares inalámbricos. Utilizando una combinación de datos de sensores, aprendizaje automático y física, MobilePoser rastrea con precisión la postura de todo el cuerpo de una persona y su traducción global en el espacio en tiempo real.

«Al ejecutarse en tiempo real en dispositivos móviles, MobilePoser logra una precisión de vanguardia a través del aprendizaje automático avanzado y la optimización basada en la física, desbloqueando nuevas posibilidades en juegos, fitness y navegación en interiores sin necesidad de equipo especializado», dijo Karan Ahuja de Northwestern. quien dirigió el estudio. «Esta tecnología marca un salto significativo hacia la captura de movimiento móvil, haciendo que las experiencias inmersivas sean más accesibles y abriendo puertas a aplicaciones innovadoras en diversas industrias».

El equipo de Ahuja presentará MobilePoser el 15 de octubre en el Simposio ACM 2024 sobre software y tecnología de interfaz de usuario en Pittsburg. «MobilePoser: estimación de poses de cuerpo completo en tiempo real y traducción humana 3D desde IMU en dispositivos móviles de consumo» se llevará a cabo como parte de una sesión sobre «Poses como entrada».

Ahuja, experto en interacción persona-computadora, es profesor asistente de Ciencias de la Computación Lisa Wissner-Slivka y Benjamin Slivka en la Escuela de Ingeniería McCormick de Northwestern, donde dirige el Laboratorio de Sensación, Percepción, Computación Interactiva y Experiencia (SPICE).

Limitaciones de los sistemas actuales

La mayoría de los cinéfilos están familiarizados con las técnicas de captura de movimiento, que a menudo se revelan en imágenes detrás de escena. Para crear personajes CGI, como Gollum en «El señor de los anillos» o los Na’vi en «Avatar», los actores usan trajes ajustados cubiertos de sensores, mientras merodean por salas especializadas. Una computadora captura los datos del sensor y luego muestra los movimientos y expresiones sutiles del actor.

«Este es el estándar de oro de la captura de movimiento, pero ejecutar esa configuración cuesta más de 100.000 dólares», dijo Ahuja. «Queríamos desarrollar una versión accesible y democratizada que básicamente cualquiera pueda usar con el equipo que ya tiene».

Otros sistemas de detección de movimiento, como Microsoft Kinect, por ejemplo, dependen de cámaras fijas que observan los movimientos corporales. Si una persona está dentro del campo de visión de la cámara, estos sistemas funcionan bien. Pero no son prácticos para aplicaciones móviles o en movimiento.

MobilePoser puede realizar estimaciones de poses de cuerpo completo en tiempo real y traducciones humanas en 3D utilizando IMU en dispositivos móviles de consumo. Crédito: Karan Ahuja/Universidad Northwestern

Predecir poses

Para superar estas limitaciones, el equipo de Ahuja recurrió a unidades de medición inercial (IMU), un sistema que utiliza una combinación de sensores (acelerómetros, giroscopios y magnetómetros) para medir el movimiento y la orientación de un cuerpo.

Estos sensores ya se encuentran en teléfonos inteligentes y otros dispositivos, pero la fidelidad es demasiado baja para aplicaciones precisas de captura de movimiento. Para mejorar su rendimiento, el equipo de Ahuja agregó un algoritmo de inteligencia artificial (IA) de múltiples etapas personalizado, que entrenaron utilizando un gran conjunto de datos disponible públicamente de mediciones IMU sintetizadas generadas a partir de datos de captura de movimiento de alta calidad.

Con los datos del sensor, MobilePoser obtiene información sobre la aceleración y la orientación del cuerpo. Luego, alimenta estos datos a través de un algoritmo de IA, que estima las posiciones y rotaciones de las articulaciones, la velocidad y dirección de la marcha y el contacto entre los pies del usuario y el suelo.

Finalmente, MobilePoser utiliza un optimizador basado en la física para refinar los movimientos previstos y garantizar que coincidan con los movimientos del cuerpo de la vida real. En la vida real, por ejemplo, las articulaciones no pueden doblarse hacia atrás y la cabeza no puede girar 360 grados. El optimizador de física garantiza que los movimientos capturados tampoco puedan moverse de formas físicamente imposibles.

El sistema resultante tiene un error de seguimiento de sólo 8 a 10 centímetros. A modo de comparación, Microsoft Kinect tiene un error de seguimiento de 4 a 5 centímetros, suponiendo que el usuario permanezca dentro del campo de visión de la cámara. Con MobilePoser, el usuario tiene libertad para moverse.

«La precisión es mejor cuando una persona lleva más de un dispositivo, como un reloj inteligente en la muñeca y un teléfono inteligente en el bolsillo», dijo Ahuja. «Pero una parte clave del sistema es que es adaptable. Incluso si un día no tienes tu reloj y solo tienes tu teléfono, puede adaptarse para determinar tu postura de cuerpo completo».

Casos de uso potenciales

Si bien MobilePoser podría ofrecer a los jugadores experiencias más inmersivas, la nueva aplicación también presenta nuevas posibilidades para la salud y el fitness. Va más allá de simplemente contar pasos para permitir al usuario ver la postura de todo el cuerpo, de modo que pueda asegurarse de que su forma sea correcta al hacer ejercicio. La nueva aplicación también podría ayudar a los médicos a analizar la movilidad, el nivel de actividad y la marcha de los pacientes. Ahuja también imagina que la tecnología podría usarse para la navegación en interiores, una debilidad actual del GPS, que sólo funciona en exteriores.

«En este momento, los médicos siguen la movilidad del paciente con un contador de pasos», dijo Ahuja. «Eso es un poco triste, ¿verdad? Nuestros teléfonos pueden calcular la temperatura en Roma. Saben más sobre el mundo exterior que sobre nuestro propio cuerpo. Nos gustaría que los teléfonos fueran algo más que simples contadores de pasos inteligentes. Un teléfono debería poder detectar diferentes actividades, determina tus poses y sé un asistente más proactivo.»

Para alentar a otros investigadores a aprovechar este trabajo, el equipo de Ahuja ha lanzó sus modelos pre-entrenadosscripts de preprocesamiento de datos y código de entrenamiento de modelos como software de código abierto. Ahuja también dice que la aplicación pronto estará disponible para iPhone, AirPods y Apple Watch.

Más información:

Vasco Xu et al, MobilePoser: estimación de la postura del cuerpo completo en tiempo real y traducción humana en 3D desde IMU en dispositivos móviles de consumo, Actas del 37º Simposio anual de ACM sobre software y tecnología de interfaz de usuario (2024). DOI: 10.1145/3654777.3676461

Citación: La nueva aplicación realiza captura de movimiento de todo el cuerpo en tiempo real con un teléfono inteligente (2024, 15 de octubre) recuperado el 15 de octubre de 2024 de https://techxplore.com/news/2024-10-app-real-full-body-motion .html

Este documento está sujeto a derechos de autor. Aparte de cualquier trato justo con fines de estudio o investigación privados, ninguna parte puede reproducirse sin el permiso por escrito. El contenido se proporciona únicamente con fines informativos.

GIPHY App Key not set. Please check settings