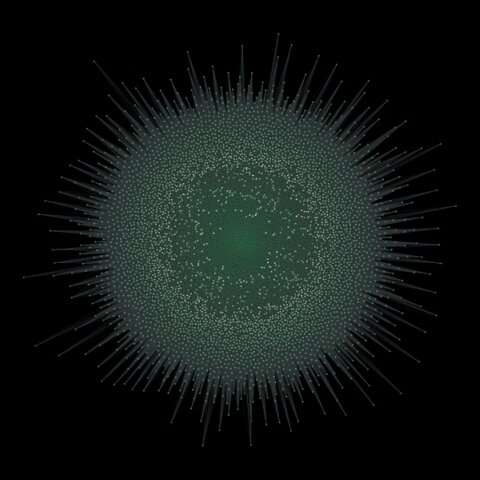

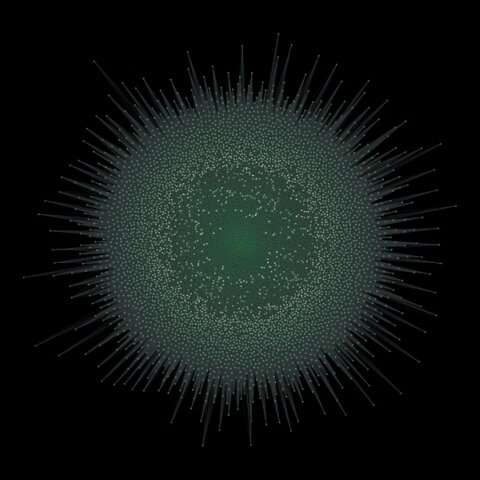

Cada punto representa a un usuario de Twitter discutiendo sobre el COVID-19 del 16 al 22 de abril de 2021. Cuanto más cerca estén los puntos del centro, mayor será la influencia. Cuanto más brillante es el color, más fuerte es la intención. Crédito: ORNL

El uso de la desinformación para crear inestabilidad política y confusión en el campo de batalla se remonta a milenios.

Sin embargo, los actores de la desinformación de hoy en día utilizan las redes sociales para amplificar la desinformación que los usuarios perpetúan a sabiendas o, más a menudo, sin saberlo. Tal desinformación se propaga rápidamente, amenazando la salud y la seguridad públicas. De hecho, la pandemia de COVID-19 y las recientes elecciones mundiales le han dado al mundo un asiento de primera fila para esta forma de guerra moderna.

Un grupo de ORNL ahora estudia tales amenazas gracias a la evolución en el laboratorio de inteligencia de ubicación, o investigación que utiliza datos abiertos para comprender los lugares y los factores que influyen en la actividad humana en ellos. En el pasado, la inteligencia de ubicación ha informado la respuesta a emergencias, la planificación urbana, la planificación del transporte, la conservación de energía y las decisiones políticas. Ahora, la inteligencia de ubicación en ORNL también ayuda a identificar la desinformación o la información compartida que es intencionalmente engañosa y sus impactos.

«Hasta ahora, sabíamos que existían campañas de desinformación en línea, pero no sabíamos cómo fluía la desinformación», dijo Gautam Thakur, líder del Location Intelligence Group de ORNL. «Al cerrar la brecha entre el mundo virtual y el mundo físico, ahora podemos ayudar a proporcionar información que las agencias y organizaciones pueden usar para contrarrestar tales amenazas».

Las campañas de desinformación de hoy se propagan rápida y profundamente. Los actores de la desinformación diseñan mensajes cuidadosamente elaborados dirigidos a audiencias específicas. Para difundir la desinformación, estos actores a menudo usan bots o algoritmos informáticos que emulan el comportamiento humano en línea. Solo unas pocas narrativas necesitan prenderse para crear vulnerabilidad, generar cohesión entre grupos extremistas o erosionar la confianza civil.

Parte del trabajo más reciente del grupo consiste en comprender cómo medir la intención de los usuarios de las redes sociales en función de los tweets enviados durante la pandemia de COVID-19.

«Descubrimos que necesitábamos un método automatizado para cuantificar la intención de todos los usuarios de las redes sociales para ayudar a mantener al público a salvo de los actores de desinformación», dijo Chathika Gunaratne, investigadora postdoctoral en la Dirección de Computación y Ciencias Computacionales de ORNL.

Con la ayuda de la ingeniera de datos computacionales Varisara Tansakul y el investigador de ciencia de datos Debraj De, el equipo multidisciplinario probó un nuevo enfoque en 4.7 millones de tweets relacionados con COVID-19 de más de 14,000 usuarios. El equipo combinó los resultados de este estudio con sus otros estudios sobre intención y desinformación. Como resultado, ahora puede correlacionar las notificaciones de noticias de última hora con las respuestas en línea de los actores de la desinformación, incorporando información como los patrones espaciales únicos de difusión de la información y los métodos utilizados por los usuarios de las redes sociales para intensificar esta difusión. Parte de este trabajo se captura en el último documento de la conferencia del grupo publicado en septiembre de 2022 en Modelado social, cultural y conductual.

Thakur comenzó a recopilar datos sobre actividades humanas cuando llegó a ORNL en 2013, pero pronto se dio cuenta de que el laboratorio necesitaba la capacidad de caracterizar, en tiempo real, los comportamientos humanos que generaban los datos. Luego, en 2015, ORNL lanzó PlanetSense, una plataforma digital utilizada para analizar datos en línea de fuentes múltiples en tiempo real. PlanetSense permite a los investigadores estudiar la actividad humana a través de los lentes de la economía, la cultura y los lazos sociales, e ilustrar cómo y por qué suceden las cosas en diferentes lugares. Desde entonces, PlanetSense ha respaldado el desarrollo de otras herramientas digitales en ORNL utilizadas en la investigación de la dinámica humana.

«Si bien construimos sistemas informáticos que capturan datos de puntos de interés en todo el planeta, es realmente comprender los lazos culturales y sociales lo que nos permite comprender mejor las actividades humanas», dijo Thakur. «Para ayudar a las agencias y organizaciones a responder a ciertos eventos, necesitamos poder dar sentido a los datos, lo que significa que debemos estar preparados para narrar ciertas actividades a medida que ocurren. Esto requiere un enfoque muy interdisciplinario, lo cual es posible en ORNL dada nuestra amplitud de ciencias fundamentales».

Más información:

Chathika Gunaratne et al, Evolución de las redes de intención e influencia social y su importancia en la detección de actores de desinformación de COVID-19 en las redes sociales, Modelado social, cultural y conductual (2022). DOI: 10.1007/978-3-031-17114-7_3

Citación: Location intelligence arroja luz sobre la desinformación (2023, 17 de abril) recuperado el 17 de abril de 2023 de https://techxplore.com/news/2023-04-intelligence-disinformation.html

Este documento está sujeto a derechos de autor. Aparte de cualquier trato justo con fines de estudio o investigación privados, ninguna parte puede reproducirse sin el permiso por escrito. El contenido se proporciona únicamente con fines informativos.