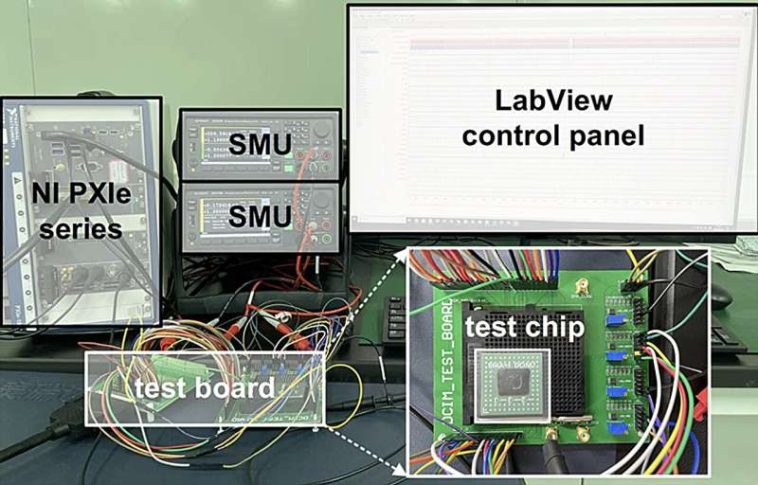

La plataforma experimental y de medición que utilizó el equipo para evaluar los chips nvDCIM. Crédito: Electrónica de la naturaleza (2025). DOI: 10.1038/s41928-025-01479-y

Para realizar predicciones precisas y completar de manera confiable las tareas deseadas, la mayoría de los sistemas de inteligencia artificial (IA) necesitan analizar rápidamente grandes cantidades de datos. Actualmente, esto implica la transferencia de datos entre unidades de procesamiento y de memoria, que en los dispositivos electrónicos existentes están separadas.

En los últimos años, muchos ingenieros han intentado desarrollar nuevo hardware que pueda ejecutar algoritmos de IA de manera más eficiente, conocidos como sistemas de computación en memoria (CIM). Los sistemas CIM son componentes electrónicos que pueden realizar cálculos y almacenar información, y normalmente sirven como procesadores y memorias no volátiles. No volátil significa esencialmente que pueden retener datos incluso cuando están apagados.

La mayoría de los diseños CIM introducidos anteriormente se basan en enfoques de computación analógica, que permiten a los dispositivos realizar cálculos aprovechando la corriente eléctrica. A pesar de su buena eficiencia energética, se sabe que las técnicas de computación analógica son significativamente menos precisas que los métodos de computación digital y a menudo no logran manejar de manera confiable grandes modelos de IA o grandes cantidades de datos.

Investigadores de la Universidad de Ciencia y Tecnología del Sur, la Universidad Xi’an Jiaotong y otros institutos desarrollaron recientemente un nuevo chip CIM prometedor que podría ayudar a ejecutar modelos de IA más rápido y con mayor eficiencia energética.

Su sistema propuesto, descrito en un artículo. publicado en Electrónica de la naturalezase basa en la llamada memoria de acceso aleatorio magnético de par de transferencia de espín (STT-MRAM), un dispositivo espintrónico que puede almacenar unidades binarias de información (es decir, 0 y 1) en la orientación magnética de una de sus capas subyacentes.

Uso de la espintrónica para ejecutar la IA de manera más eficiente

Los dispositivos STT-MRAM, como el empleado por este equipo de investigación, consisten esencialmente en una pequeña estructura conocida como unión de túnel magnético (MTJ). Esta estructura tiene tres capas, una capa magnética con una orientación «fija», una capa magnética que puede cambiar su orientación y una fina capa aislante que separa las otras dos capas.

Cuando las dos capas magnéticas tienen direcciones magnéticas paralelas, los electrones pueden atravesar fácilmente el dispositivo, pero mientras son opuestas, la resistencia aumenta y el flujo de electrones se vuelve más desafiante. Los dispositivos STT-MRAM aprovechan estos dos estados diferentes para almacenar datos binarios.

«Las macros CIM no volátiles (es decir, módulos funcionales prediseñados dentro de un chip que pueden procesar y almacenar datos) pueden reducir la transferencia de datos entre las unidades de procesamiento y de memoria, proporcionando cálculos de inteligencia artificial rápidos y energéticamente eficientes», escribieron Humiao Li, Zheng Chai y sus colegas en su artículo.

«Sin embargo, la arquitectura CIM no volátil generalmente se basa en computación analógica, que es limitada en términos de precisión, escalabilidad y robustez. Presentamos una macro de computación en memoria digital no volátil de 64 kb basada en tecnología STT-MRAM de 40 nm».

Un paso hacia un hardware de IA más escalable

El módulo basado en STT-MRAM presentado por los investigadores puede realizar cálculos y almacenar bits de manera confiable, todo dentro de un solo dispositivo. En las pruebas iniciales, funcionó notablemente bien, ejecutando dos tipos distintos de redes neuronales con una velocidad y precisión notables.

«Nuestra macro presenta multiplicación y digitalización in situ a nivel de celda de bits, suma y acumulación digital reconfigurable con precisión a nivel macro y un esquema de entrenamiento que tiene en cuenta la velocidad de conmutación a nivel de algoritmo», escribieron los autores. «La macro admite multiplicaciones de matrices y vectores sin pérdidas con precisiones de peso y entrada flexibles (4, 8, 12 y 16 bits), y puede lograr una precisión de inferencia equivalente al software para una red residual con una precisión de 8 bits y redes neuronales informadas por la física con una precisión de 16 bits.

«Nuestra macro tiene latencias de cálculo de 7,4 a 29,6 ns y eficiencias energéticas de 7,02 a 112,3 teraoperaciones por segundo por vatio para multiplicaciones de matrices y vectores totalmente paralelas en configuraciones de precisión que van de 4 a 16 bits».

En el futuro, el módulo CIM recientemente desarrollado por el equipo podría contribuir a la implementación energéticamente eficiente de IA directamente en dispositivos portátiles, sin tener que depender de grandes centros de datos. En los próximos años, también podría inspirar el desarrollo de sistemas CIM similares basados en STT-MRAM u otros dispositivos espintrónicos.

Escrito para ti por nuestro autor Ingrid Fadellieditado por Lisa Locky verificados y revisados por Robert Egan—Este artículo es el resultado de un cuidadoso trabajo humano. Dependemos de lectores como usted para mantener vivo el periodismo científico independiente. Si este informe es importante para usted, considere una donación (especialmente mensual). Obtendrás un sin publicidad cuenta como agradecimiento.

Más información:

Humiao Li et al, Una macro de computación en memoria espintrónica totalmente paralela y sin pérdidas para chips de inteligencia artificial, Electrónica de la naturaleza (2025). DOI: 10.1038/s41928-025-01479-y

© 2025 Red Ciencia X

Citación: La eficiencia de la IA avanza con un chip de memoria espintrónico que combina almacenamiento y procesamiento (2025, 29 de octubre) recuperado el 29 de octubre de 2025 de https://techxplore.com/news/2025-10-ai-efficiency-advances-spintronic-memory.html

Este documento está sujeto a derechos de autor. Aparte de cualquier trato justo con fines de estudio o investigación privados, ninguna parte puede reproducirse sin el permiso por escrito. El contenido se proporciona únicamente con fines informativos.