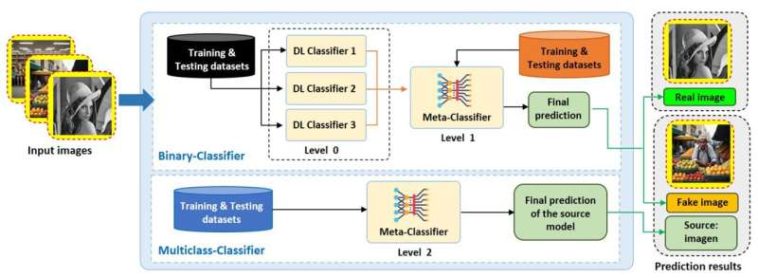

Arquitectura de alto nivel de Deepguard. Crédito: Electrónica (2025). Doi: 10.3390/electronics14040665

Las imágenes realistas creadas por la inteligencia artificial (AI), incluidas las generadas a partir de una descripción del texto y las utilizadas en video, representan una amenaza genuina para la seguridad personal. Desde el robo de identidad hasta el mal uso de una imagen personal, detectar lo real y lo que es falso es cada vez más difícil.

Una colaboración de investigación que involucra el centro de investigación de inteligencia artificial y ciencia de datos de la Universidad de Portsmouth (pagos) ha desarrollado una solución innovadora para distinguir con precisión entre imágenes falsas y genuinas, así como identificar la fuente de la imagen artificial.

La solución, conocida como DeepGuard, combina tres técnicas avanzadas de IA, que son clasificación binaria, aprendizaje conjunto y clasificación de clase múltiple. Estos métodos permiten que la IA aprenda de los datos etiquetados, haciendo predicciones más inteligentes y confiables.

Es una herramienta que puede usarse para investigar y enjuiciar actividades delictivas como el fraude, o por los medios de comunicación para garantizar que las imágenes utilizadas en sus historias sean auténticas para evitar la información errónea o el sesgo involuntario.

Deepguard ha sido desarrollado por un equipo de investigación dirigido por el Dr. Guleltoum Bendiab y Yasmine Namani del Departamento de Electrónica de la Universidad de Frères Mentouri en Argelia, e involucrando al Dr. Stavros Shiaeles del Centro de Investigación Pagos de la Universidad y la Escuela de Computación.

El Dr. Shiaeles dijo: «Con las capacidades tecnológicas en constante evolución, será un desafío constante detectar imágenes falsas con el ojo humano. Las imágenes manipuladas representan una amenaza significativa para nuestra privacidad y seguridad, ya que pueden usarse para forjar documentos para el chantaje, socavar las elecciones, falsificar la evidencia electrónica y las reputaciones de daños y los daños, e incluso se pueden utilizar para incitar el daño, por adultos, a los niños.

«Las personas también se están beneficiando falsamente en las plataformas de redes sociales como Tiktok, donde las imágenes de modelos se convierten en personajes y se animan en diferentes escenarios en los juegos o para el entretenimiento.

«Deepguard y futuras iteraciones deberían ser una medida de seguridad valiosa para verificar las imágenes, incluidas las de los videos, en una amplia gama de contextos».

El investigaciónpublicado en Electrónicatambién apoyará una mayor investigación académica en esta área, con conjuntos de datos adicionales Disponible para académicos.

Durante su desarrollo, el equipo revisó y analizó métodos para la manipulación y detección de imágenes, centrándose específicamente en imágenes falsas que involucran alteraciones faciales y corporales. Consideraron 255 artículos de investigación publicados entre 2016 y 2023 que examinaron varias técnicas para detectar imágenes manipuladas, como cambios en la expresión, pose, voz u otras características faciales o corporales.

Más información:

Yasmine Namani et al, Deepguard: identificación y atribución de imágenes sintéticas generadas por IA, Electrónica (2025). Doi: 10.3390/electronics14040665

Citación: El nuevo software ayudará a combatir las amenazas de imagen falsa profundas para la seguridad personal (2025, 3 de marzo) recuperado el 3 de marzo de 2025 de https://techxplore.com/news/2025-03-software-combat-deep-fake-image.html

Este documento está sujeto a derechos de autor. Además de cualquier trato justo con el propósito de estudio o investigación privada, no se puede reproducir ninguna parte sin el permiso por escrito. El contenido se proporciona solo para fines de información.

GIPHY App Key not set. Please check settings