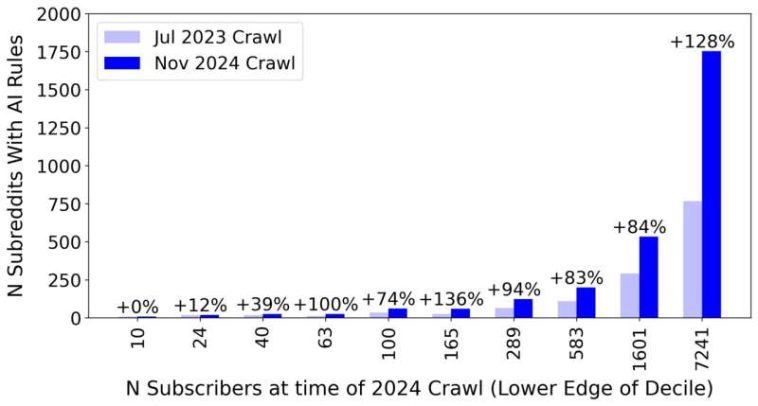

Número de subreddits en el subreddit longitudinal establecido con reglas de IA. Los subreddits se desequen en deciles en función de su recuento de suscriptores en el momento del segundo rastreo. Las etiquetas sobre las barras indican un cambio porcentual entre rastreos. Crédito: arxiv (2024). Doi: 10.48550/arxiv.2410.11698

Los investigadores de Cornell Tech han publicado un conjunto de datos extraído de más de 300,000 comunidades públicas de Reddit, y un informe que detalla cómo las comunidades de Reddit están cambiando sus políticas para abordar un aumento en el contenido generado por IA.

El equipo recolectó metadatos y reglas de la comunidad de las comunidades en línea, conocidas como subreddits, durante dos períodos en julio de 2023 y noviembre de 2024. Los investigadores presentarán un documento con sus hallazgos en la Conferencia de CHI de la Asociación de Machinería de Computación sobre Factores Humanos en los sistemas de computación que se celebran del 26 de abril al 1 de mayo en Yokohama, Japón.

Uno de los descubrimientos más llamativos de los investigadores es el rápido aumento de los subreddits con reglas que rigen el uso de la IA. Según la investigación, el número de subreddits con reglas de IA se duplicó en 16 meses, desde julio de 2023 hasta noviembre de 2024.

«Esto es importante porque demuestra que la preocupación de la IA se está extendiendo en estas comunidades. Sube la cuestión de si las comunidades tienen o no las herramientas que necesitan para hacer cumplir de manera efectiva y equitativa estas políticas», dijo Travis Lloyd, un estudiante de doctorado de Cornell Tech y uno de los investigadores que iniciaron el proyecto en 2023.

El estudio encontró que las reglas de IA son más comunes en los subreddits centrados en el arte y los temas de celebridades. Estas comunidades a menudo comparten contenido visual, y sus reglas con frecuencia abordan las preocupaciones sobre la calidad y la autenticidad de las imágenes, el audio y el video generados por la IA. Los subreddits más grandes también tenían significativamente más probabilidades de tener estas reglas, lo que refleja las crecientes preocupaciones sobre la IA entre las comunidades con bases de usuarios más grandes.

«Este documento utiliza reglas de la comunidad para proporcionar una primera visión de cómo nuestras comunidades en línea se enfrentan con la posible interrupción generalizada que trae la IA generativa», dijo el coautor Mor Naaman, profesor del Instituto Jacobs Technion-Cornell en Cornell Tech, y de la ciencia de la información en el Cornell Ann S. Bowers College of Computing and Information Science. «Mirar las acciones de los moderadores y los cambios en las reglas nos dio una forma única de reflexionar sobre cómo los diferentes subreddits se ven afectados y se resisten, o no, el uso de IA en sus comunidades».

A medida que evoluciona la IA generativa, los investigadores instan a los diseñadores de la plataforma a priorizar las preocupaciones de la comunidad sobre la calidad y la autenticidad expuestas en los datos. El estudio también destaca la importancia de las opciones de diseño de la plataforma «sensible al contexto», que consideran cómo los diferentes tipos de comunidades adoptan enfoques variados para regular el uso de IA.

Por ejemplo, la investigación sugiere que las comunidades más grandes pueden estar más inclinadas a usar reglas formales y explícitas para mantener la calidad del contenido y gobernar el uso de IA. Por el contrario, las comunidades más personales y muy unidas pueden confiar en métodos informales, como las normas y expectativas sociales.

«Las plataformas más exitosas serán aquellas que capacitan a las comunidades para desarrollar y hacer cumplir sus propias normas sensibles al contexto sobre el uso de la IA. Lo más importante es que las plataformas no adoptan un enfoque de arriba hacia abajo que obliga a una sola política de IA en todas las comunidades», dijo Lloyd. «Las comunidades deben poder elegir por sí mismas si desean permitir la nueva tecnología, y los diseñadores de plataformas deben explorar nuevas herramientas de moderación que puedan ayudar a las comunidades a detectar el uso de IA».

Al hacer público su conjunto de datos, los investigadores tienen como objetivo permitir estudios futuros que puedan explorar más a fondo el autogobierno de la comunidad en línea y el impacto de la IA en las interacciones en línea.

Los hallazgos son publicado en el arxiv servidor de preimpresión.

Más información:

Travis Lloyd et al, ¿AI reglas? Caracterizar las políticas comunitarias de Reddit hacia el contenido generado por la IA, arxiv (2024). Doi: 10.48550/arxiv.2410.11698

GitHub: github.com/stechlab/airules

Citación: El conjunto de datos revela cómo las comunidades Reddit se están adaptando a AI (2025, 7 de abril) Recuperado el 7 de abril de 2025 de https://techxplore.com/news/2025-04-dataset-reveals-reddit-communities-ai.html

Este documento está sujeto a derechos de autor. Además de cualquier trato justo con el propósito de estudio o investigación privada, no se puede reproducir ninguna parte sin el permiso por escrito. El contenido se proporciona solo para fines de información.

GIPHY App Key not set. Please check settings