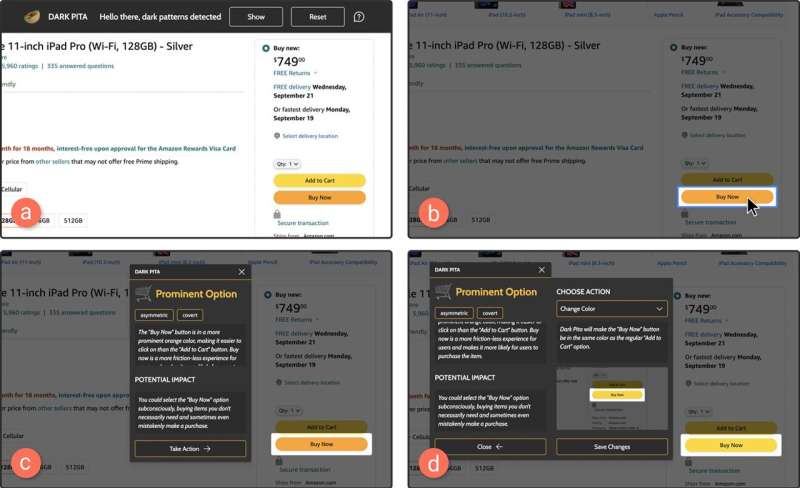

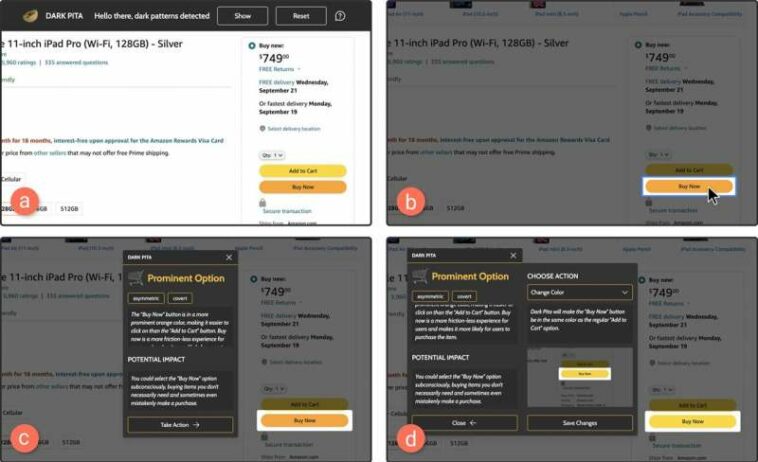

El complemento del navegador Dark Pita detecta diseños de patrones oscuros, notifica al usuario y le permite personalizar su experiencia en línea. Crédito: Toby Li / Universidad de Notre Dame

Investigadores de la Universidad de Notre Dame están desarrollando herramientas de inteligencia artificial que ayuden a los consumidores a comprender cómo están siendo explotados mientras navegan por plataformas en línea. El objetivo es impulsar la alfabetización digital de los usuarios finales para que puedan controlar mejor cómo interactúan con estos sitios web.

En un estudio reciente apareciendo en Actas de la Conferencia CHI sobre factores humanos en sistemas informáticos, se invitó a los participantes a experimentar con configuraciones de privacidad en línea sin consecuencias. Para probar cómo funcionan las diferentes configuraciones de privacidad de datos, los investigadores crearon un complemento del navegador Chrome llamado Privacy Sandbox que reemplazó los datos de los participantes con personas generadas por GPT-4, un modelo de lenguaje grande de OpenAI.

Con Privacy Sandbox, los participantes podrían interactuar con diferentes sitios web, como plataformas de redes sociales o medios de comunicación. Mientras navegaban por varios sitios, el complemento del navegador aplicaba datos generados por IA, lo que hacía más obvio para los participantes ver cómo eran atacados en función de su supuesta edad, raza, ubicación, ingresos, tamaño del hogar y más.

«Desde la perspectiva del usuario, permitir el acceso de la plataforma a datos privados puede ser atractivo porque podría obtener mejor contenido, pero una vez que la enciendes, no puedes recuperar esos datos. Una vez que lo haces, el sitio ya sabe dónde estás. vivir», dijo Toby Li, profesor asistente de ciencias de la computación e ingeniería y miembro de la facultad del Lucy Family Institute for Data & Society de Notre Dame, quien dirigió la investigación. «Esto es algo que queríamos que los participantes comprendieran, descubrieran si el entorno vale la pena en un entorno libre de riesgos y les permitiera tomar decisiones informadas».

Otro estudioeste en Actas de la ACM sobre interacción persona-computadora, analizó los patrones oscuros (o las características de diseño en las plataformas digitales que empujan sutilmente a los usuarios a realizar acciones específicas) y cómo se utilizan en los sitios web para manipular a los clientes. Para el estudio, Li y su equipo observaron cómo los diseñadores de interfaces aplican patrones oscuros para alentar a las personas a consumir más contenido o tomar decisiones de compra impulsivas.

Los investigadores desarrollaron un complemento del navegador Chrome denominado Dark Pita para identificar patrones oscuros en cinco plataformas en línea populares: Amazon, YouTube, Netflix, Facebook y X.

Utilizando el aprendizaje automático, el complemento primero notificaría a los participantes del estudio que se detectó un patrón oscuro. Luego identificaría la susceptibilidad a las amenazas del patrón oscuro y explicaría el impacto del patrón oscuro: pérdida financiera, invasión de la privacidad o carga cognitiva. Luego, Dark Pita les daría a los participantes la opción de «tomar medidas» modificando el código del sitio web a través de una interfaz fácil de usar para cambiar las características de diseño engañosas del sitio y explicar el efecto de la modificación.

Los investigadores planean eventualmente poner a disposición del público ambos complementos del navegador, Privacy Sandbox y Dark Pita. Li cree que estas herramientas son excelentes ejemplos de cómo se puede democratizar el uso de la IA para que los usuarios habituales beneficien a la sociedad.

«Las empresas utilizarán cada vez más la IA en su beneficio, lo que seguirá ampliando la brecha de poder entre ellas y los usuarios. Por eso, con nuestra investigación, estamos explorando cómo podemos devolver el poder al público permitiéndoles utilizar las herramientas de IA de la mejor manera posible. interés frente a los algoritmos opresivos existentes. Este enfoque de ‘combatir fuego con fuego’ debería nivelar un poco el campo de juego», dijo Li.

«Un enfoque de zona de pruebas basado en la empatía para cerrar la brecha de privacidad entre actitudes, objetivos, conocimientos y comportamientos» se presentó en la Conferencia CHI de la Asociación de Maquinaria de Computación 2024. Dirigidos por Li, los coautores del estudio incluyen a Chaoran Chen y Yanfang (Fanny) Ye de Notre Dame, Weijun Li de la Universidad de Zhejiang, Wenxin Song de la Universidad China de Hong Kong y Yaxing Yao de Virginia Tech.

El estudio «De la conciencia a la acción: exploración de intervenciones de empoderamiento del usuario final para patrones oscuros en UX», dirigido por Li, ha sido publicado en Actas de la ACM sobre interacción persona-computadora (CSCW 2024). Los coautores incluyen a Yuwen Lu de Notre Dame, Chao Zhang de la Universidad de Cornell, Yuewen Yang de Cornell Tech y Yao de Virginia Tech.

Más información:

Chaoran Chen et al, Un enfoque de zona de pruebas basado en la empatía para cerrar la brecha de privacidad entre actitudes, objetivos, conocimientos y comportamientos, Actas de la Conferencia CHI sobre factores humanos en sistemas informáticos (2024). DOI: 10.1145/3613904.3642363

Yuwen Lu et al, De la conciencia a la acción: exploración de intervenciones de empoderamiento del usuario final para patrones oscuros en UX, Actas de la ACM sobre interacción persona-computadora (2024). DOI: 10.1145/3637336

Citación: Complementos de navegador de IA para ayudar a los consumidores a mejorar la alfabetización sobre privacidad digital y combatir el diseño manipulador (2024, 29 de mayo) obtenido el 29 de mayo de 2024 de https://techxplore.com/news/2024-05-ai-browser-ins-consumers- digital.html

Este documento está sujeto a derechos de autor. Aparte de cualquier trato justo con fines de estudio o investigación privados, ninguna parte puede reproducirse sin el permiso por escrito. El contenido se proporciona únicamente con fines informativos.

GIPHY App Key not set. Please check settings