Las funciones de accesibilidad se centran en mejorar una interfaz para una discapacidad en particular, pero a menudo pueden mejorar las experiencias para todos los usuarios. La nueva función Live Captions, actualmente en prueba beta en ciertos dispositivos y países, es un buen ejemplo. Apple tiene como objetivo convertir todo el audio producido por su dispositivo en texto legible transcrito con precisión, al igual que Live Text puede extraer texto de imágenes de mapa de bits.

Para habilitar la función, debe tener un iPhone 11 o posterior con iOS 16 instalado, un iPad relativamente reciente con iPadOS 16 (consulte esta lista) o una Mac Apple silicon (M1 o M2) con macOS Ventura instalado. Para iPhones y iPads, Apple dice que Live Captions solo funciona cuando el idioma del dispositivo está configurado en inglés (EE. UU.) o inglés (Canadá). La descripción de macOS dice más ampliamente que la versión beta «no está disponible en todos los idiomas, países o regiones».

Si puede usar subtítulos en vivo (o quiere verificar si puede), vaya a Ajustes (iOS/iPadOS)/Ajustes del sistema (Ventura) > Accesibilidad. Si ve un elemento de Live Captions (Beta), puede usarlo. Toca o haz clic Subtítulos en vivo para permitir. A continuación, puede tocar Apariencia en iOS/iPadOS o use los elementos del menú de nivel superior en macOS para modificar cómo aparecen los subtítulos. Puede habilitar o deshabilitar por separado los subtítulos en vivo en FaceTime para que aparezcan subtítulos en esa aplicación.

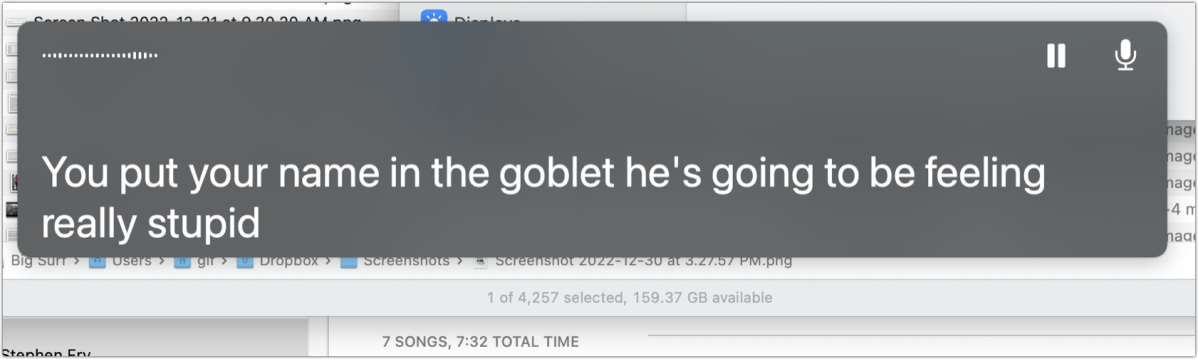

Los subtítulos en vivo aparecen como una superposición que muestra su interpretación de audio en inglés de cualquier sonido producido por su sistema. Una forma de onda de audio en vivo coincide con el sonido que Live Captions «escucha». En iOS y iPadOS, puede tocar la superposición y acceder a controles adicionales: minimizar, pausar, micrófono y pantalla completa; en macOS, están disponibles la pausa y el botón del micrófono. Si toca o hace clic en el botón del micrófono, puede hablar y hacer que lo que diga aparezca en la pantalla. Esto podría ser útil si está tratando de mostrarle a alguien el texto de lo que está diciendo.

El texto producido en Live Captions es efímero: no se puede copiar ni pegar. También es resistente a las capturas de pantalla de dispositivos móviles: aparentemente, la superposición se genera de tal manera que iOS y iPadOS no pueden capturarla.

Live Captions es muy prometedor, algo a lo que hay que estar atento a medida que mejora y se expande. Probé Live Captions con podcasts, YouTube y audio de Instagram. No fue tan bueno como algunas transcripciones basadas en IA que he visto, como en las videoconferencias, pero hizo un gran esfuerzo y fue superior a no tener subtítulos.

Apple podría vincular los subtítulos en vivo a su función de traducción integrada, y es posible que pueda usarlos para hablar en su propio idioma y mostrar una versión traducida a alguien en su lengua, o tener transcripciones en vivo de transmisiones de video, podcasts y otros. audio en un idioma que no sea el que usted habla.

Este artículo sobre Mac 911 es una respuesta a una pregunta enviada por Kevin, lector de Macworld.

Pregúntale a Mac 911

Hemos compilado una lista de las preguntas que nos hacen con más frecuencia, junto con respuestas y enlaces a columnas: lea nuestras súper preguntas frecuentes para ver si su pregunta está cubierta. Si no, ¡siempre estamos buscando nuevos problemas para resolver! Envíe el suyo por correo electrónico a [email protected], incluyendo capturas de pantalla según corresponda y si desea que se use su nombre completo. No se responderán todas las preguntas, no respondemos a los correos electrónicos y no podemos proporcionar consejos directos para la resolución de problemas.