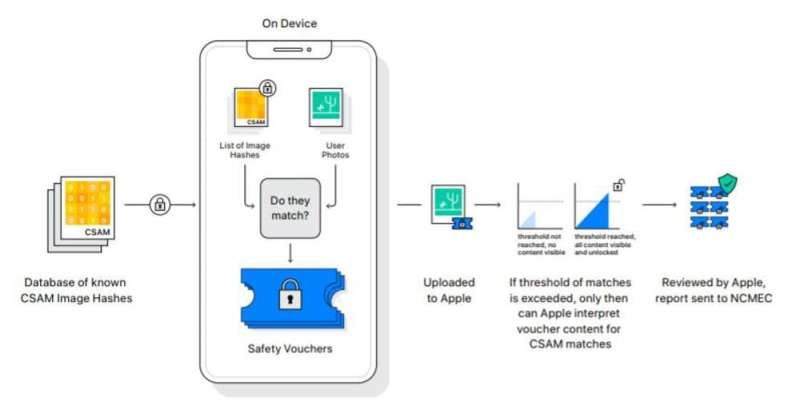

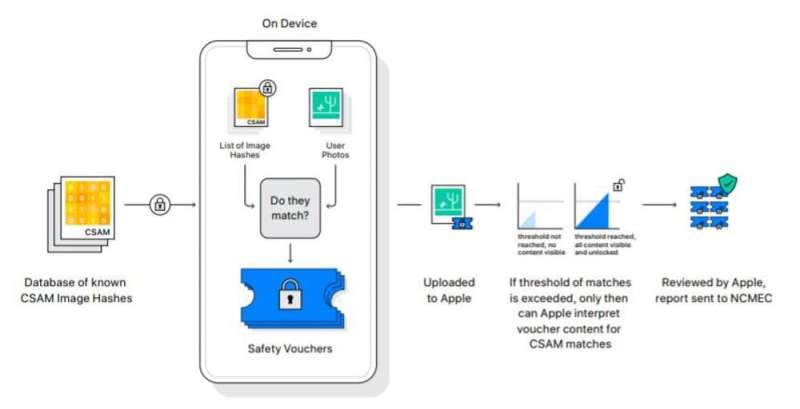

El nuevo sistema de Apple para comparar sus fotos con una base de datos de imágenes conocidas de abuso infantil funciona en su dispositivo en lugar de en un servidor. Crédito: manzana

La proliferación de material de abuso sexual infantil en Internet es angustioso y aleccionador. Las empresas de tecnología envían decenas de millones de informes por año de estas imágenes a la organización sin fines de lucro Centro Nacional para Niños Desaparecidos y Explotados.

La forma en que las empresas que proporcionan almacenamiento en la nube para sus imágenes generalmente detectan el material de abuso infantil lo deja vulnerable a violaciones de privacidad por parte de las empresas y de los piratas informáticos que ingresan a sus computadoras. El 5 de agosto de 2021, Apple anunció una nueva forma de detectar este material que promete proteger mejor su privacidad.

Como un científico de la computación que estudia criptografía, puedo explicar cómo funciona el sistema de Apple, por qué es una mejora y por qué Apple necesita hacer más.

¿Quién tiene la llave?

Los archivos digitales se pueden proteger en una especie de caja de seguridad virtual a través del cifrado, que distorsiona un archivo para que pueda ser revelado o descifrado, solo por alguien que tenga una clave secreta. El cifrado es una de las mejores herramientas para proteger la información personal mientras atraviesa Internet.

¿Puede un proveedor de servicios en la nube detectar material de abuso infantil si las fotos están distorsionadas mediante cifrado? Depende de quién tenga la clave secreta.

Muchos proveedores de la nube, incluido Apple, guardan una copia de la clave secreta para poder ayudarlo a recuperación de datos si olvida su contraseña. Con la llave el proveedor también puede coincidir fotos almacenadas en la nube contra imágenes de abuso infantil conocidas en poder del Centro Nacional para Niños Desaparecidos y Explotados.

Pero esta conveniencia tiene un gran costo. Un proveedor en la nube que almacena claves secretas podría abusar de su acceso a tus datos o caer presa de un Filtración de datos.

Un mejor enfoque para la seguridad en línea es encriptado de fin a fin, en el que la clave secreta se almacena solo en su propia computadora, teléfono o tableta. En este caso, el proveedor no puede descifrar sus fotos. La respuesta de Apple a la verificación de material de abuso infantil que está protegido por cifrado de extremo a extremo es un nuevo procedimiento en el que el proveedor de servicios en la nube, es decir, Apple, y su dispositivo realizan la comparación de imágenes juntos.

Detectar evidencia sin mirarla

Aunque eso pueda parecer mágico, con la criptografía moderna es posible trabajar con datos que no se pueden ver. He contribuido a proyectos que utilizan criptografía para medir la brecha salarial de género sin saber el salario de nadie, y para detectar delincuentes reincidentes de agresión sexual sin leer el informe de ninguna víctima. Y aquí están muchos más ejemplos de empresas y gobiernos que utilizan computación protegida criptográficamente para proporcionar servicios mientras se protegen los datos subyacentes.

Coincidencia de imágenes propuesta por Apple on iCloud Photos utiliza una computadora protegida criptográficamente para escanear fotos sin verlas. Está basado en una herramienta llamada intersección de set privado que ha sido estudiado por criptógrafos desde la década de 1980. Esta herramienta permite que dos personas descubran archivos que tienen en común mientras ocultan el resto.

Así es como funciona la coincidencia de imágenes. Apple distribuye a los iPhone, iPad y Mac de todos una base de datos que contiene codificaciones indescifrables de imágenes conocidas de abuso infantil. Por cada foto que cargue en iCloud, su dispositivo aplica una huella digital, llamado NeuralHash. La toma de huellas dactilares funciona incluso si alguien hace pequeños cambios en una foto. Luego, su dispositivo crea un cupón para su foto que su dispositivo no puede entender, pero que le dice al servidor si la foto cargada coincide con el material de abuso infantil en la base de datos.

Si suficientes cupones de un dispositivo indican coincidencias con imágenes conocidas de abuso infantil, el servidor aprende las claves secretas para descifrar todas las fotos coincidentes, pero no las claves de otras fotos. De lo contrario, el servidor no podrá ver ninguna de sus fotos.

Hacer que este procedimiento de coincidencia se lleve a cabo en su dispositivo puede ser mejor para su privacidad que los métodos anteriores, en los que la coincidencia se realiza en un servidor, si se implementa correctamente. Pero esa es una gran advertencia.

Averiguar qué podría salir mal

Hay una línea en la película «Apollo 13» en el que Gene Kranz, interpretado por Ed Harris, proclama: «No me importa para qué fue diseñado todo. ¡Me importa lo que pueda hacer!» La tecnología de escaneo de teléfonos de Apple está diseñada para proteger la privacidad. Los expertos en seguridad informática y políticas tecnológicas están capacitados para descubrir formas en que se puede usar, abusar y abusar de una tecnología, independientemente de la intención de su creador. Sin embargo, el anuncio de Apple carece de información para analizar componentes esenciales, por lo que no es posible evaluar la seguridad de su nuevo sistema.

Los investigadores de seguridad necesitan ver el código de Apple para validar que el software de emparejamiento asistido por dispositivo es fiel al diseño y no introduce errores. Los investigadores también deben probar si es posible engañar al algoritmo NeuralHash de Apple para que cambie las huellas dactilares mediante hacer cambios imperceptibles en una foto.

También es importante que Apple desarrolle una política de auditoría para responsabilizar a la empresa de hacer coincidir solo las imágenes de abuso infantil. La amenaza de un avance de la misión era un riesgo incluso con el emparejamiento basado en servidor. La buena noticia es que los dispositivos coincidentes ofrecen nuevas oportunidades para auditar las acciones de Apple porque la base de datos codificada vincula a Apple a un conjunto de imágenes específico. Apple debería permitir que todos verifiquen que han recibido la misma base de datos codificada y auditores externos para validar las imágenes contenidas en este conjunto. Estos objetivos de responsabilidad pública se puede lograr usando criptografía.

La tecnología de coincidencia de imágenes propuesta por Apple tiene el potencial de mejorar la privacidad digital y la seguridad infantil, especialmente si Apple sigue este movimiento al dar cifrado de extremo a extremo de iCloud. Pero ninguna tecnología por sí sola puede responder por completo a problemas sociales complejos. Todas las opciones sobre cómo utilizar el cifrado y el escaneo de imágenes tienen efectos delicados y matizados en la sociedad.

Estas delicadas preguntas requieren tiempo y espacio para razonar a través de las posibles consecuencias de incluso acciones bien intencionadas antes de implementarlas, a través de diálogo con grupos afectados e investigadores con una amplia variedad de antecedentes. Insto a Apple a unirse a este diálogo para que la comunidad de investigación pueda mejorar colectivamente la seguridad y la responsabilidad de esta nueva tecnología.

La actualización de Apple comprobará los iPhones en busca de imágenes de abuso sexual infantil

Este artículo se vuelve a publicar desde La conversación bajo una licencia Creative Commons. Leer el artículo original.![]()

Citación: Apple puede escanear sus fotos en busca de abuso infantil y aún proteger su privacidad (2021, 11 de agosto) recuperado el 13 de agosto de 2021 de https://techxplore.com/news/2021-08-apple-scan-photos-child-abuse.html

Este documento está sujeto a derechos de autor. Aparte de cualquier trato justo con fines de estudio o investigación privados, no se puede reproducir ninguna parte sin el permiso por escrito. El contenido se proporciona únicamente con fines informativos.

GIPHY App Key not set. Please check settings