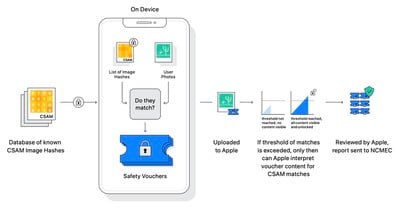

Apple anunció esta semana que, a partir de finales de este año con iOS 15 y iPadOS 15, la compañía podrá detectar imágenes conocidas de Material de abuso sexual infantil (CSAM) almacenadas en iCloud Photos, lo que permitirá a Apple reportar estas instancias al Centro Nacional para Personas Desaparecidas. y Exploited Children, una organización sin fines de lucro que trabaja en colaboración con las agencias de aplicación de la ley en los Estados Unidos.

/article-new/2021/08/apple-csam-flow-chart.jpg?lossy)

Los planes han despertado la preocupación entre algunos investigadores de seguridad y otras partes de que los gobiernos podrían eventualmente obligar a Apple a agregar imágenes que no sean CSAM a la lista hash con fines nefastos, como reprimir el activismo político.

«No importa lo bien intencionado que sea, Apple está implementando la vigilancia masiva en todo el mundo con esto», dicho el destacado denunciante Edward Snowden, y agregó que «si pueden escanear en busca de pornografía infantil hoy, podrán escanear cualquier cosa mañana». La Electronic Frontier Foundation sin fines de lucro también criticó los planes de Apple, afirmando que «incluso una puerta trasera minuciosamente documentada, cuidadosamente pensada y de alcance limitado sigue siendo una puerta trasera».

Para abordar estas preocupaciones, Apple brindó comentarios adicionales sobre sus planes de hoy.

El conocido sistema de detección de CSAM de Apple se limitará a los Estados Unidos en el momento del lanzamiento, y para abordar la posibilidad de que algunos gobiernos intenten abusar del sistema, Apple confirmó a MacRumors que la compañía considerará cualquier posible expansión global del sistema en un país- por país después de realizar una evaluación legal. Apple no proporcionó un marco de tiempo para la expansión global del sistema, si tal movimiento ocurre alguna vez.

Apple también abordó la posibilidad hipotética de que una región en particular del mundo decida corromper una organización de seguridad en un intento de abusar del sistema, y señaló que la primera capa de protección del sistema es un umbral no revelado antes de que se marque a un usuario por tener imágenes inapropiadas. Incluso si se excede el umbral, Apple dijo que su proceso de revisión manual serviría como una barrera adicional y confirmaría la ausencia de imágenes CSAM conocidas. Apple dijo que, en última instancia, no informaría sobre el usuario señalado al NCMEC ni a las agencias de aplicación de la ley y que el sistema seguiría funcionando exactamente como se diseñó.

Apple también destacó a algunos defensores del sistema, y algunas partes elogiaron a la compañía por sus esfuerzos para combatir el abuso infantil.

«Apoyamos la evolución continua del enfoque de Apple hacia la seguridad infantil en línea», dijo Stephen Balkam, director ejecutivo del Family Online Safety Institute. «Dados los desafíos que enfrentan los padres para proteger a sus hijos en línea, es imperativo que las empresas de tecnología iteren y mejoren continuamente sus herramientas de seguridad para responder a nuevos riesgos y daños reales».

Apple admitió que no hay una solución milagrosa en lo que respecta al potencial de abuso del sistema, pero la compañía dijo que está comprometida a usar el sistema únicamente para la detección de imágenes CSAM conocidas.

Nota: Debido a la naturaleza política o social de la discusión sobre este tema, el hilo de discusión se encuentra en nuestro Noticias políticas foro. Todos los miembros del foro y los visitantes del sitio pueden leer y seguir el hilo, pero la publicación está limitada a los miembros del foro con al menos 100 publicaciones.

GIPHY App Key not set. Please check settings