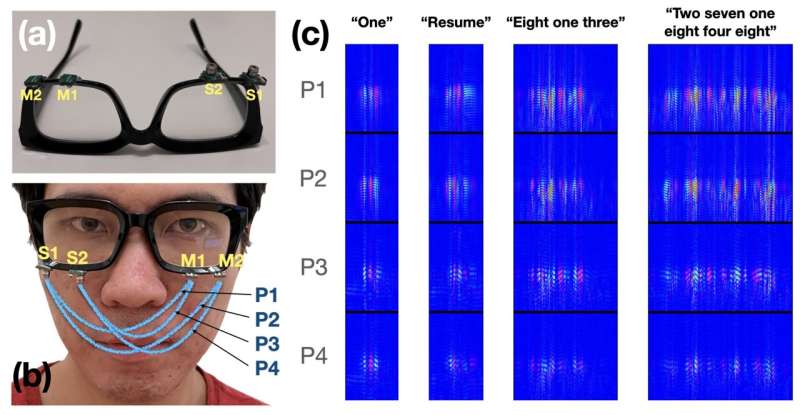

Diseño del sistema y perfiles de eco. (ab) Posición final del sensor y caminos de la señal. S1, S2: altavoces; M1, M2: micrófonos. P1-P4: Caminos. Tenga en cuenta que cada ruta consta de múltiples rutas de reflexión y difracción que se originan en el altavoz de origen y terminan en el micrófono de destino. Las líneas en la figura solo ilustran las fuentes y los objetivos. (c) Perfiles de eco para diferentes expresiones. Crédito: EchoSpeech: Reconocimiento de voz continuo y silencioso en anteojos mínimamente molestos con tecnología de detección acústica (2023).

Investigadores de la Universidad de Cornell han desarrollado una interfaz de reconocimiento de voz silenciosa que utiliza detección acústica e inteligencia artificial para reconocer continuamente hasta 31 comandos no vocalizados, basados en movimientos de labios y boca.

La interfaz portátil de bajo consumo, llamada EchoSpeech, requiere solo unos minutos de datos de capacitación del usuario antes de que reconozca los comandos y pueda ejecutarse en un teléfono inteligente.

Ruidong Zhang, estudiante de doctorado en ciencias de la información, es el autor principal de «EchoSpeech: Continuous Silent Speech Recognition on Minimally-obtrusive Eyewear Powered by Acoustic Sensing», que se presentará en la Conferencia de la Asociación de Maquinaria de Computación sobre Factores Humanos en Sistemas de Computación ( CHI) este mes en Hamburgo, Alemania.

«Para las personas que no pueden vocalizar el sonido, esta tecnología de habla silenciosa podría ser una entrada excelente para un sintetizador de voz. Podría devolverles a los pacientes sus voces», dijo Zhang sobre el uso potencial de la tecnología con un mayor desarrollo.

En su forma actual, EchoSpeech podría usarse para comunicarse con otras personas a través de un teléfono inteligente en lugares donde hablar es inconveniente o inapropiado, como un restaurante ruidoso o una biblioteca tranquila. La interfaz de voz silenciosa también se puede combinar con un lápiz óptico y usarse con software de diseño como CAD, eliminando casi por completo la necesidad de un teclado y un mouse.

Equipadas con un par de micrófonos y parlantes más pequeños que gomas de borrar, las gafas EchoSpeech se convierten en un sistema de sonar portátil alimentado por IA, que envía y recibe ondas de sonido en la cara y detecta los movimientos de la boca. Luego, un algoritmo de aprendizaje profundo analiza estos perfiles de eco en tiempo real, con una precisión de aproximadamente el 95 %.

«Estamos moviendo el sonar hacia el cuerpo», dijo Cheng Zhang, profesor asistente de ciencias de la información y director del Laboratorio de Interfaces de Computadoras Inteligentes para Interacciones Futuras (SciFi) de Cornell.

«Estamos muy entusiasmados con este sistema», dijo, «porque realmente impulsa el campo del rendimiento y la privacidad. Es pequeño, de bajo consumo y sensible a la privacidad, características importantes para implementar nuevas tecnologías portátiles en el mundo real.»

La mayor parte de la tecnología en el reconocimiento del habla silenciosa se limita a un conjunto selecto de comandos predeterminados y requiere que el usuario mire o use una cámara, lo cual no es práctico ni factible, dijo Cheng Zhang. También existen importantes preocupaciones de privacidad relacionadas con las cámaras portátiles, tanto para el usuario como para aquellos con quienes el usuario interactúa, dijo.

La tecnología de detección acústica como EchoSpeech elimina la necesidad de cámaras de video portátiles. Y debido a que los datos de audio son mucho más pequeños que los datos de imagen o video, requieren menos ancho de banda para procesarse y pueden transmitirse a un teléfono inteligente a través de Bluetooth en tiempo real, dijo François Guimbretière, profesor de ciencias de la información.

«Y debido a que los datos se procesan localmente en su teléfono inteligente en lugar de cargarse en la nube», dijo, «la información sensible a la privacidad nunca sale de su control».

Más información:

Conferencia: chi2023.acm.org/

Investigación: ruidongzhang.com/files/papers/ … _authors_version.pdf

Citación: Los anteojos equipados con IA leen el habla silenciosa (2023, 6 de abril) recuperado el 6 de abril de 2023 de https://techxplore.com/news/2023-04-ai-equiped-eyeglasses-silent-speech.html

Este documento está sujeto a derechos de autor. Aparte de cualquier trato justo con fines de estudio o investigación privados, ninguna parte puede reproducirse sin el permiso por escrito. El contenido se proporciona únicamente con fines informativos.