|

|

Hoy, me complace anunciar una nueva personalización sin servidor en Amazon SageMaker AI para modelos de IA populares, como Amazon Nova, DeepSeek, GPT-OSS, Llama y Qwen. La nueva capacidad de personalización proporciona una interfaz fácil de usar para las últimas técnicas de ajuste, como el aprendizaje por refuerzo, para que pueda acelerar el proceso de personalización del modelo de IA de meses a días.

Con unos pocos clics, puede seleccionar sin problemas un modelo y una técnica de personalización, y gestionar la evaluación y la implementación del modelo, todo ello sin servidor para que pueda centrarse en el ajuste del modelo en lugar de administrar la infraestructura. Cuando elige la personalización sin servidor, SageMaker AI selecciona y aprovisiona automáticamente los recursos informáticos adecuados según el modelo y el tamaño de los datos.

Comenzando con la personalización del modelo sin servidor

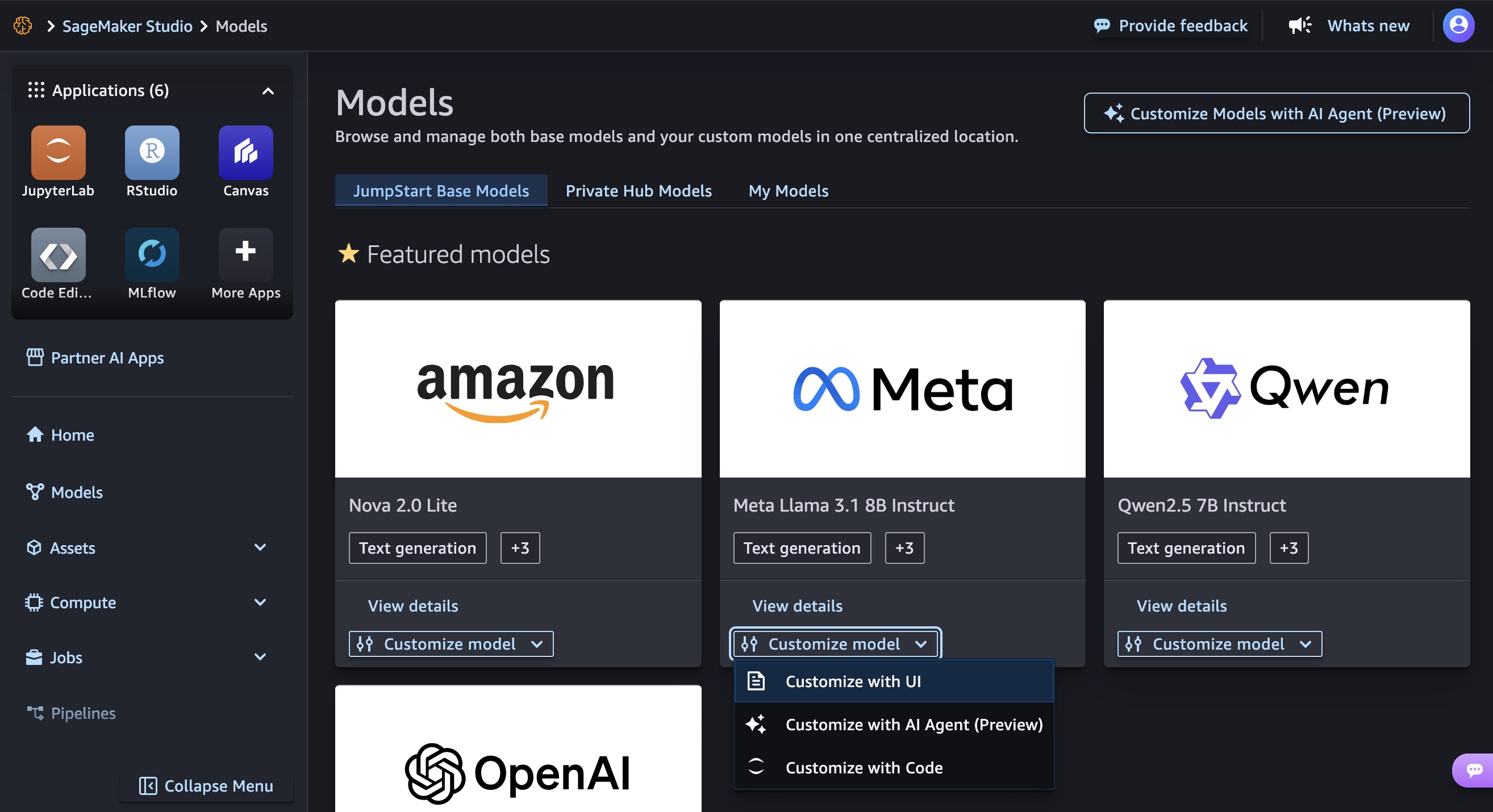

Puede comenzar a personalizar modelos en Amazon SageMaker Studio. Elegir Modelos en el panel de navegación izquierdo y consulte sus modelos de IA favoritos para personalizarlos.

Personalizar con la interfaz de usuario

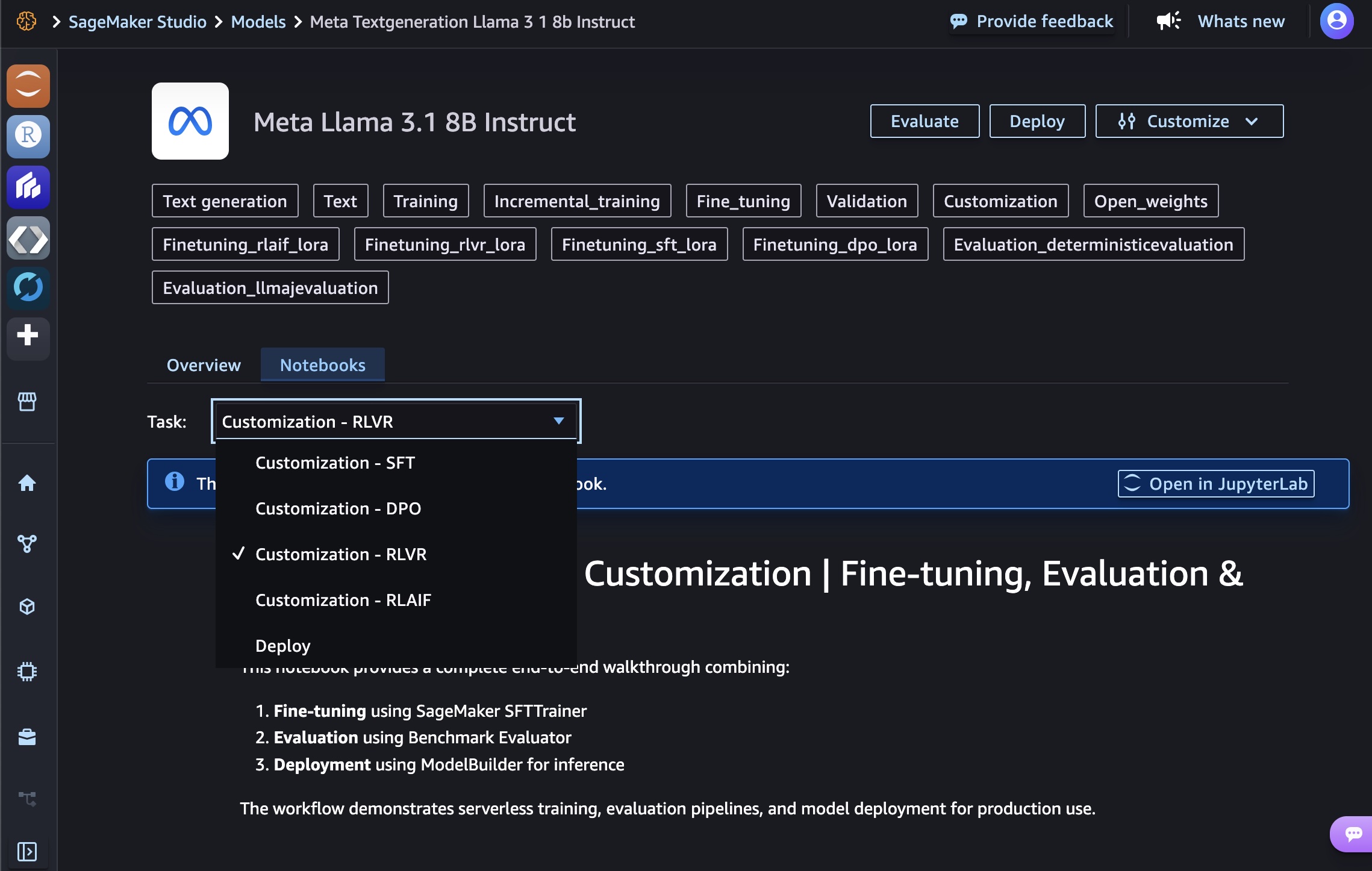

Puede personalizar los modelos de IA con unos pocos clics. En el Personalizar modelo lista desplegable para un modelo específico, como Meta Llama 3.1 8B Instrucciónelegir Personalizar con la interfaz de usuario.

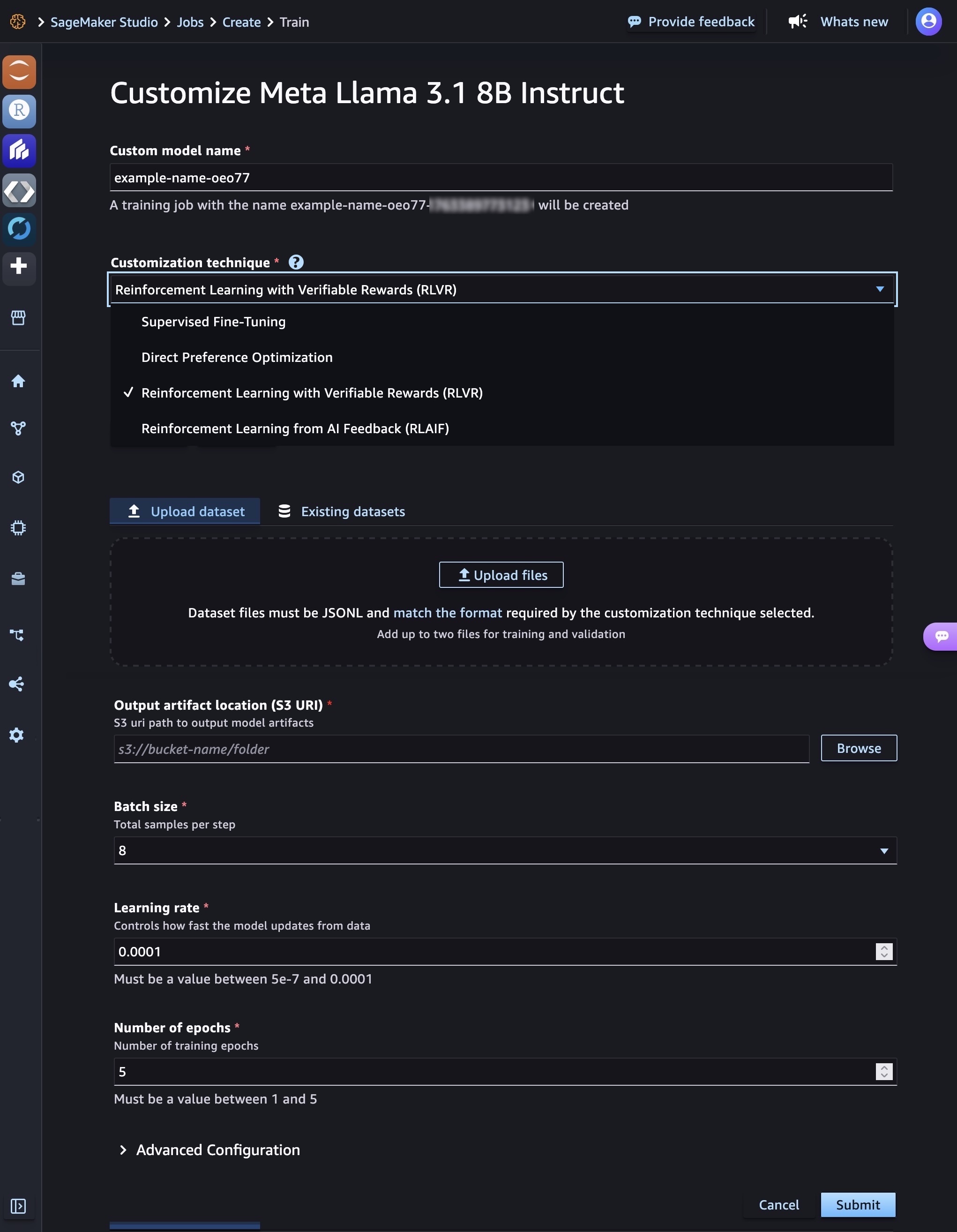

Puede seleccionar una técnica de personalización utilizada para adaptar el modelo base a su caso de uso. Soportes de SageMaker AI Ajuste supervisado y las últimas técnicas de personalización de modelos, incluidas Optimización de preferencias directas, Aprendizaje reforzado a partir de recompensas verificables (RLVR)y Aprendizaje reforzado a partir de comentarios de IA (RLAIF). Cada técnica optimiza los modelos de diferentes maneras, con la selección influenciada por factores como el tamaño y la calidad del conjunto de datos, los recursos computacionales disponibles, la tarea en cuestión, los niveles de precisión deseados y las limitaciones de implementación.

Cargue o seleccione un conjunto de datos de entrenamiento que coincida con el formato requerido por la técnica de personalización seleccionada. Utilice los valores de tamaño de lote, tasa de aprendizaje y número de épocas recomendados por la técnica seleccionada. Puede configurar ajustes avanzados como hiperparámetros, una aplicación MLflow sin servidor recientemente introducida para el seguimiento de experimentos y cifrado de volúmenes de almacenamiento y red. Elegir Entregar para comenzar con su trabajo de capacitación de modelos.

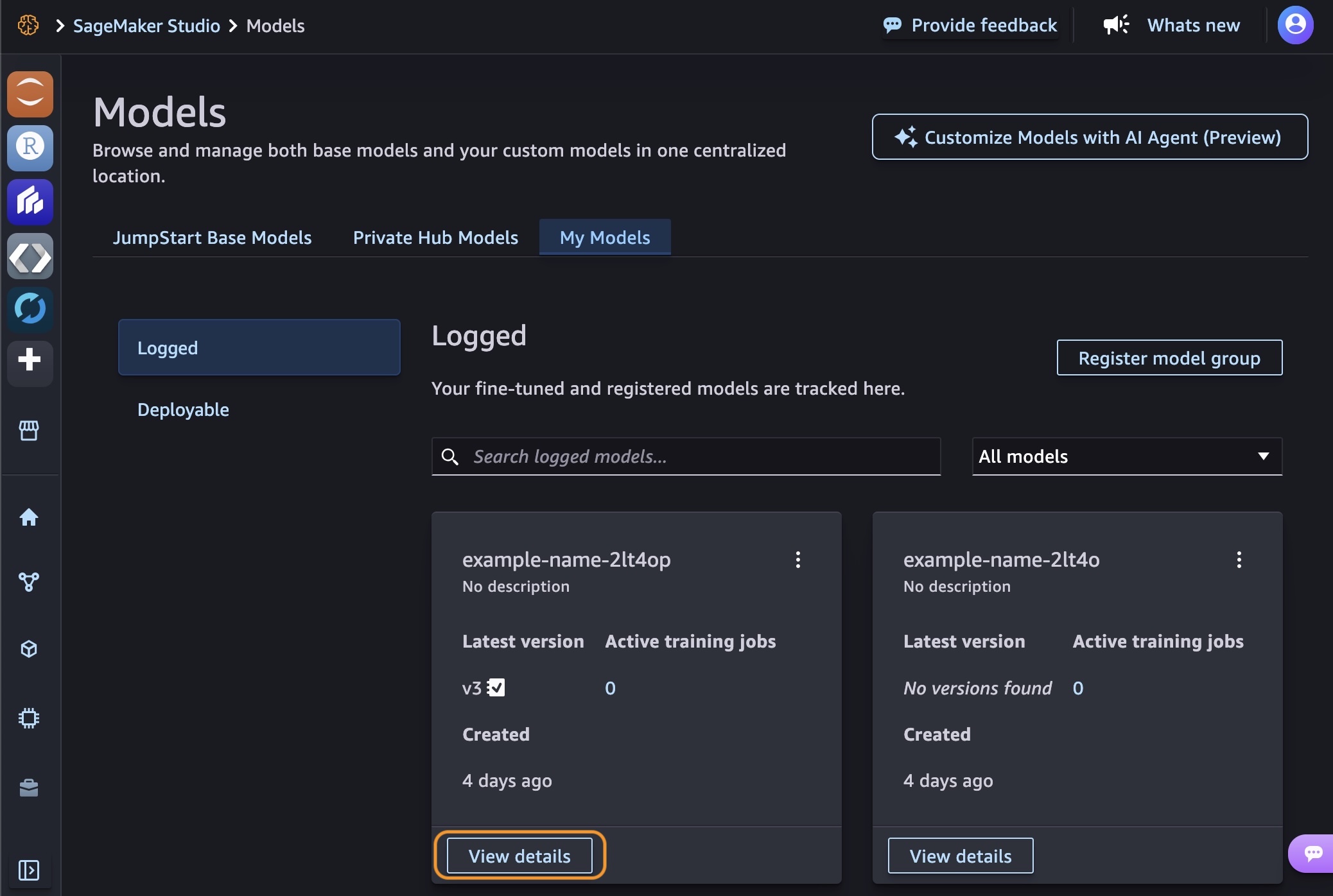

Una vez completado el trabajo de entrenamiento, podrá ver los modelos que creó en el Mis modelos pestaña. Elegir Ver detalles en uno de tus modelos.

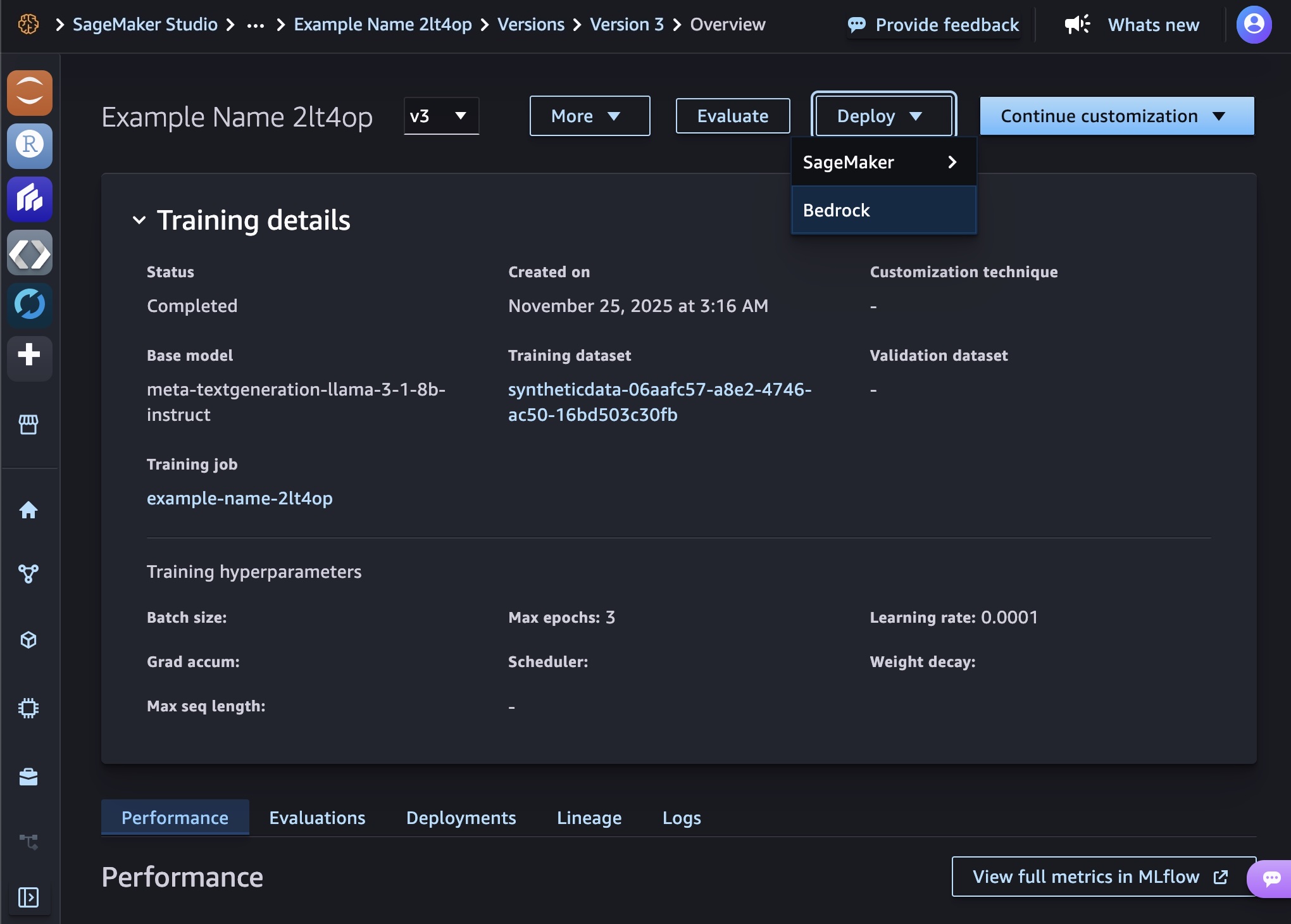

Al elegir Continuar personalizaciónpuede continuar personalizando su modelo ajustando hiperparámetros o entrenando con diferentes técnicas. Al elegir Evaluarpuede evaluar su modelo personalizado para ver su rendimiento en comparación con el modelo base.

Cuando completes ambos trabajos, podrás elegir entre el fabricante de salvia o Base en el Desplegar lista desplegable para implementar su modelo.

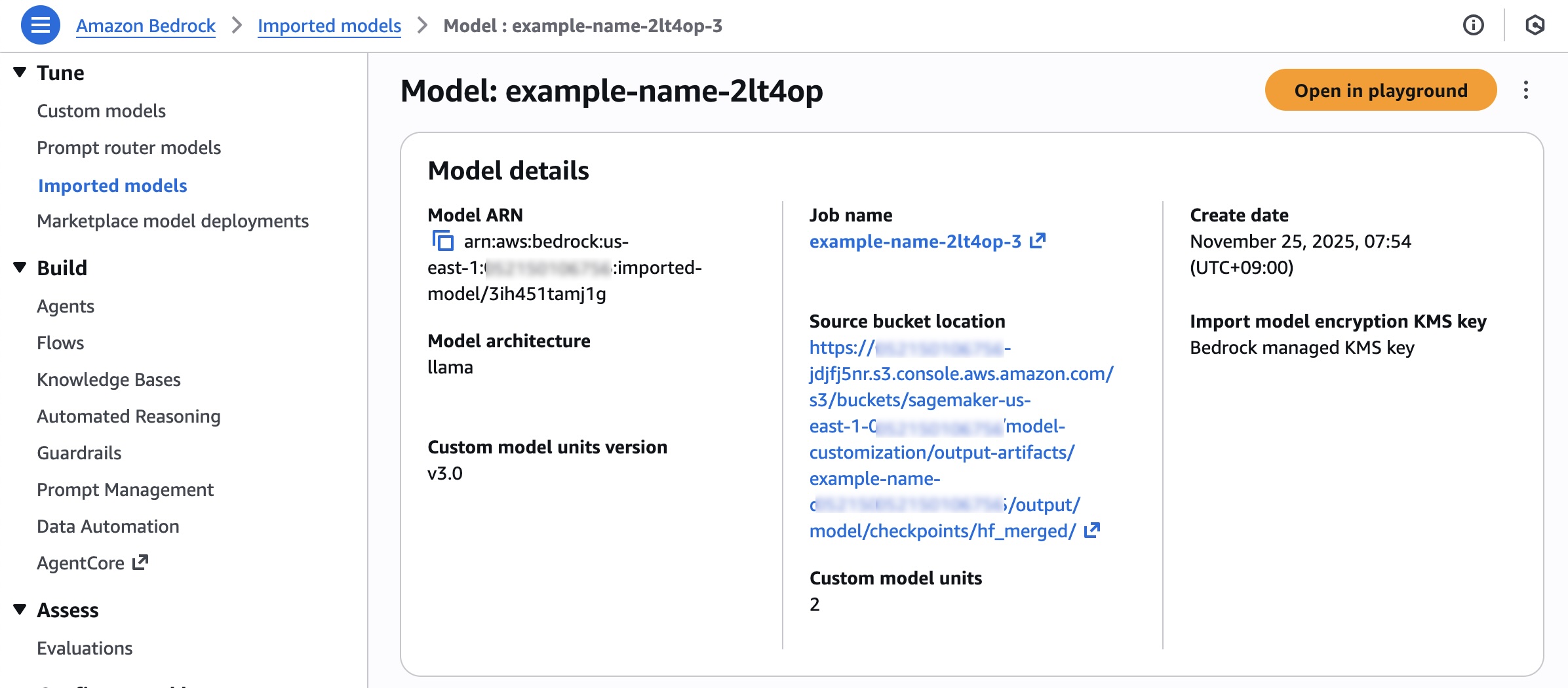

Puede elegir Amazon Bedrock para realizar inferencias sin servidor. Elegir Base y el nombre del modelo para implementar el modelo en Amazon Bedrock. Para encontrar sus modelos implementados, elija Modelos importados en la consola Bedrock.

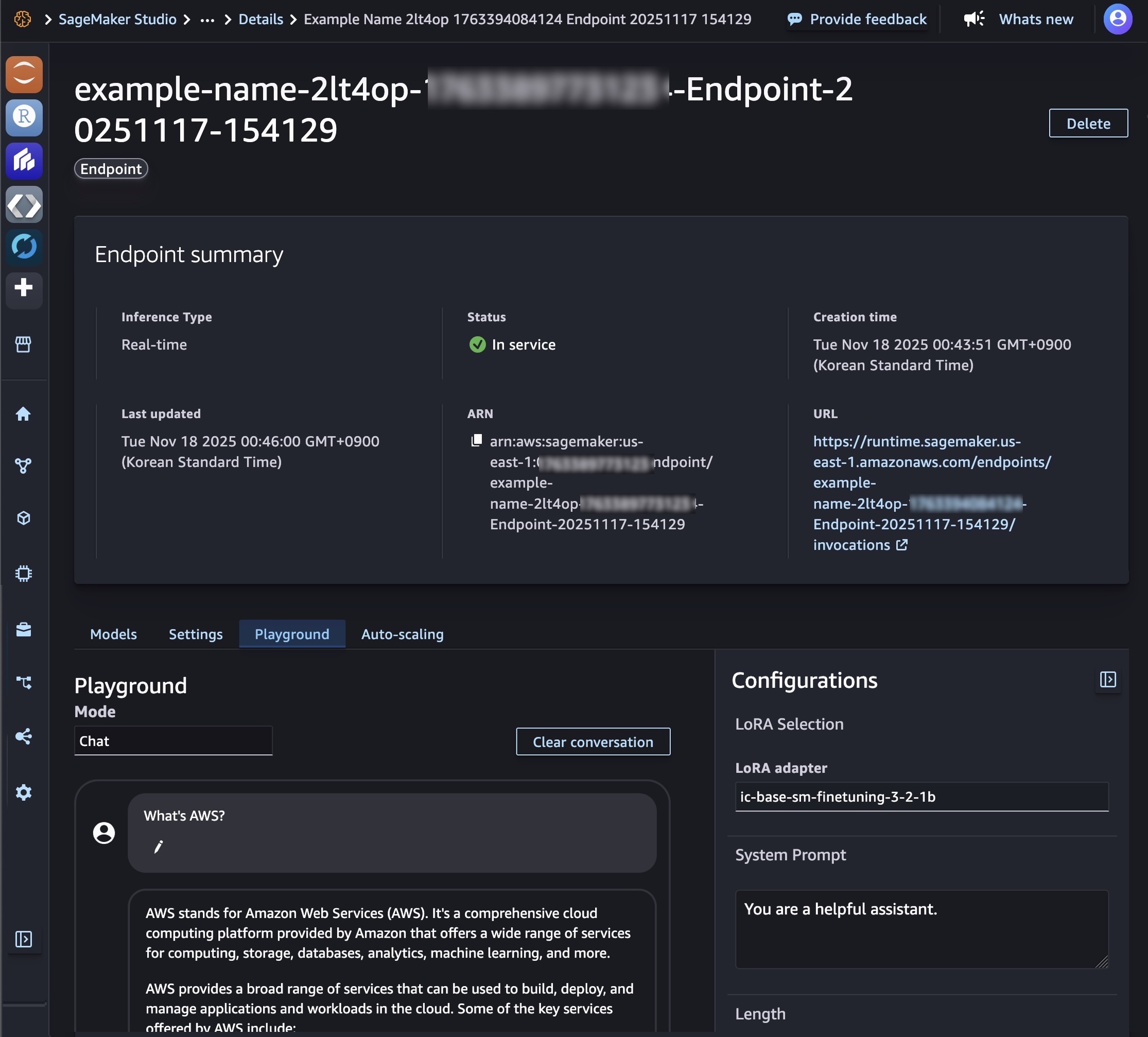

También puede implementar su modelo en un punto final de inferencia de SageMaker AI si desea controlar sus recursos de implementación, como el tipo de instancia y el recuento de instancias. Una vez finalizada la implementación de SageMaker AI en serviciopuede utilizar este punto final para realizar inferencias. En el Patio de juegos pestaña, puede probar su modelo personalizado con un solo mensaje o modo de chat.

Con la capacidad de MLflow sin servidor, puede registrar automáticamente todas las métricas experimentales críticas sin modificar el código y acceder a visualizaciones enriquecidas para análisis posteriores.

Personalizar con código

Cuando elige personalizar con código, puede ver un cuaderno de muestra para ajustar o implementar modelos de IA. Si desea editar el cuaderno de muestra, ábralo en JupyterLab. Alternativamente, puede implementar el modelo inmediatamente eligiendo Desplegar.

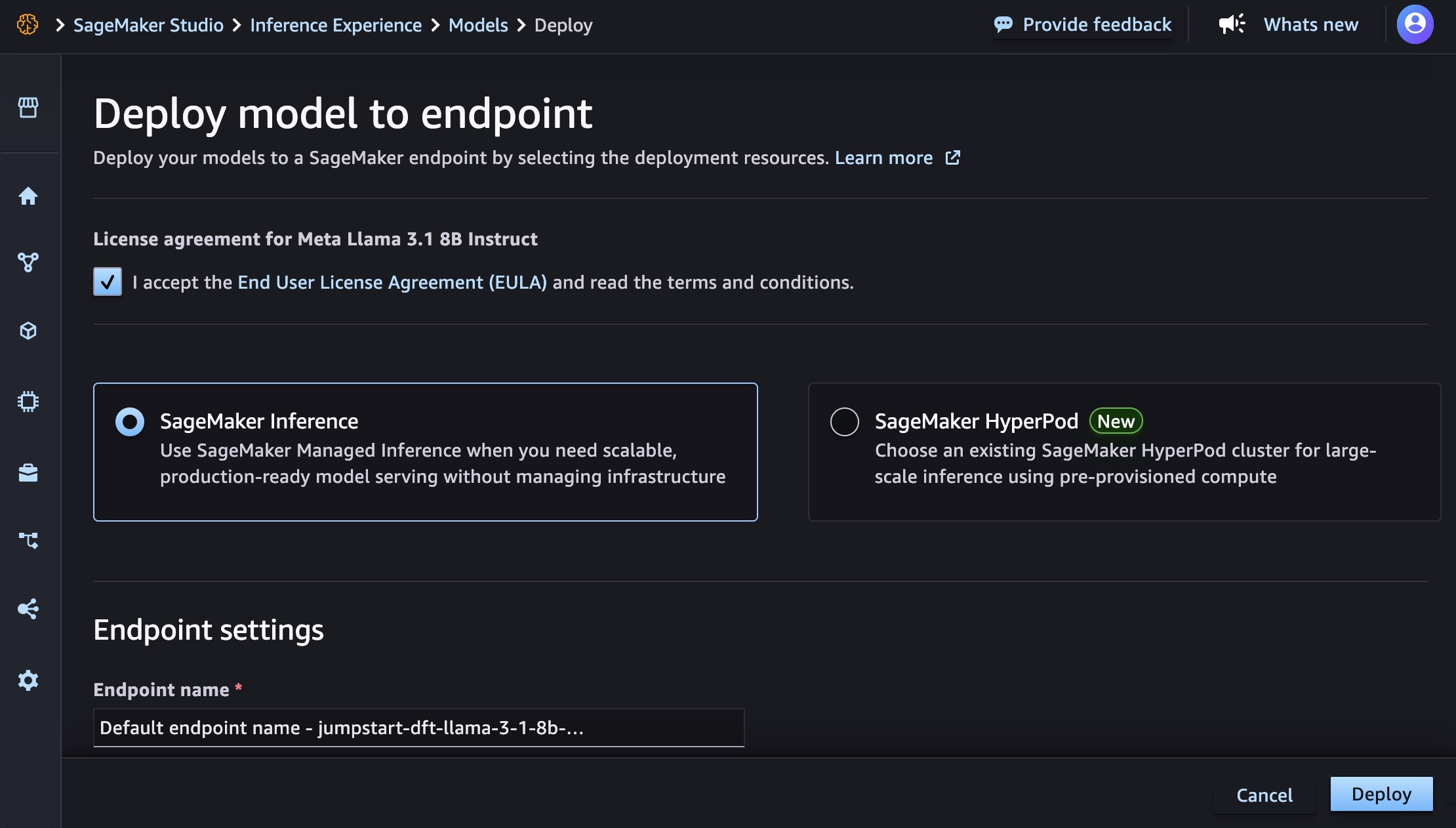

Puede elegir el punto final de Amazon Bedrock o SageMaker AI seleccionando los recursos de implementación desde Amazon SageMaker Inference o Amazon SageMaker Hyperpod.

cuando tu eliges Desplegar en la parte inferior derecha de la página, será redirigido a la página de detalles del modelo. Una vez que la implementación de SageMaker AI esté en servicio, puede utilizar este punto final para realizar inferencias.

Bien, has visto cómo optimizar la personalización del modelo en SageMaker AI. Ahora puedes elegir tu forma favorita. Para obtener más información, visite la Guía para desarrolladores de IA de Amazon SageMaker.

Ahora disponible

La nueva personalización del modelo de IA sin servidor en Amazon SageMaker AI ahora está disponible en las regiones Este de EE. UU. (Virginia del Norte), Oeste de EE. UU. (Oregón), Asia Pacífico (Tokio) y Europa (Irlanda). Solo paga por los tokens procesados durante el entrenamiento y la inferencia. Para obtener más detalles, visite la página de precios de Amazon SageMaker AI.

Pruébelo en Amazon SageMaker Studio y envíe sus comentarios a AWS re: Publicación para SageMaker o a través de sus contactos habituales de AWS Support.

— chany