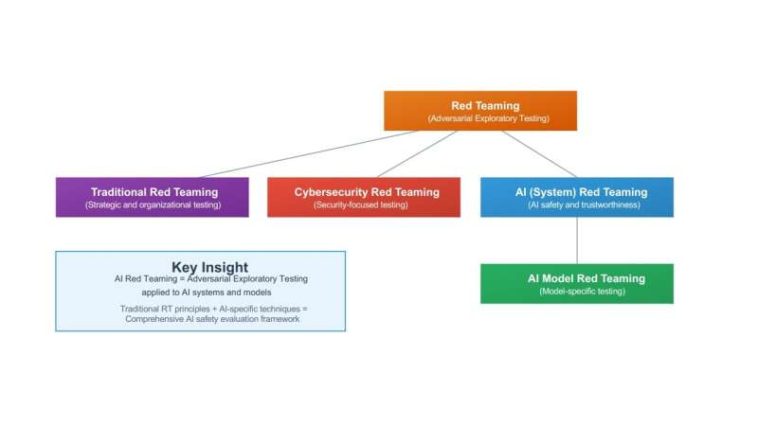

Diagrama conceptual de pruebas de software y pruebas del equipo rojo de IA. Crédito: Instituto de Investigaciones en Electrónica y Telecomunicaciones (ETRI)

A medida que la tecnología de inteligencia artificial (IA) impregna rápidamente nuestras vidas y nuestras industrias, garantizar su seguridad y confiabilidad es un desafío global. En este contexto, los investigadores coreanos están ganando terreno al liderar el desarrollo de dos estándares internacionales clave.

El Instituto de Investigación en Electrónica y Telecomunicaciones (ETRI) ha propuesto a la Organización Internacional de Normalización (ISO/IEC) el estándar «AI Red Team Testing», que tiene como objetivo identificar de forma proactiva los riesgos en los sistemas de IA, y el estándar «Trustworthiness Fact Label (TFL)», que tiene como objetivo ayudar a los consumidores a comprender fácilmente el nivel de autenticidad de la IA, y ha comenzado un desarrollo a gran escala.

Con esto, Corea ha elevado su estatus más allá de ser un simple «seguidor rápido» de la tecnología a un «primer impulsor», estableciendo las reglas para la era de la IA.

«AI Red Team Testing» es un método para explorar y probar agresivamente qué tan seguro es un sistema de IA. Por ejemplo, identifica de forma proactiva situaciones en las que la IA generativa puede producir información incorrecta o explotarse para eludir las protecciones del usuario.

ETRI actúa como editor de ISO/IEC 42119-7, el estándar internacional en este campo, creando procedimientos y métodos de prueba internacionales comunes que se pueden aplicar en una amplia gama de campos, incluidos la medicina, las finanzas y la defensa nacional.

Mientras tanto, ETRI, junto con el Ministerio de Seguridad de Alimentos y Medicamentos, organizó el primer «Taller de tecnología y desafío del equipo rojo de productos médicos digitales de IA avanzada» en Corea en el hotel Novotel Seoul Dongdaemun los días 4 y 5 de septiembre.

Este desafío es el primer evento de este tipo en Asia y Corea para dispositivos médicos avanzados de IA, donde participarán profesionales médicos, expertos en seguridad y el público en general para examinar los sesgos y riesgos de la IA.

ETRI también está desarrollando una metodología de evaluación de equipo rojo específica para médicos en colaboración con el Centro Médico Asan de Seúl, y creará un sistema de prueba de equipo rojo para productos médicos digitales que aplica tecnología avanzada de inteligencia artificial y realiza pruebas empíricas. Además, ha formado un consejo con importantes empresas como STA, NAVER, Upstage, SelectStar, KT y LG AI Research Institute para fortalecer la cooperación en la estandarización internacional del equipo rojo de IA.

Tipos y contenidos de etiquetas de hechos confiables (TFL) y aplicaciones de destino. Crédito: Instituto de Investigaciones en Electrónica y Telecomunicaciones (ETRI)

Otro estándar clave son las etiquetas de datos de confiabilidad (TFL).

La etiqueta es una visualización de un vistazo de cuán confiable es un sistema de inteligencia artificial y brinda información transparente a los consumidores, de manera muy similar a la etiqueta nutricional de un producto alimenticio.

ETRI está liderando el desarrollo de la serie de normas ISO/IEC 42117, que pueden ponerse en práctica de diversas maneras: las empresas proporcionan la información por sí mismas o hacen que una organización externa la verifique y certifique.

En el futuro, ETRI incluso está considerando incorporar factores ESG, como la huella de carbono de la IA.

Junto con el Estándar del sistema de gestión de IA (ISO/IEC 42001), que se utiliza como estándar de certificación internacional para organizaciones que utilizan IA, el estándar servirá como marco para demostrar cuán confiables son los productos y servicios desarrollados.

Estos dos estándares se alinean con las estrategias de avance Sovereign AI y AI G3 del gobierno. Esto se evalúa como un ejemplo que va más allá de simplemente asegurar la destreza tecnológica y hace una contribución práctica a la competencia por el liderazgo en la creación de reglas globales de IA.

Así como el Instituto Nacional de Estándares y Tecnología (NIST) de los Estados Unidos apoya la estandarización nacional e internacional para realizar la estrategia nacional de IA, el ETRI prevé apoyar la realización de la estrategia nacional de IA mediante el desarrollo de tecnologías de seguridad de IA y liderando la estandarización internacional de la seguridad y confiabilidad de la IA, incluidas las actividades del Instituto de Investigación de Seguridad de IA.

Kim Wook, primer ministro del Instituto de Planificación y Evaluación de Tecnologías de la Información y las Comunicaciones (IITP), dijo: «Proporcionar seguridad y confiabilidad a la IA hará que sea más fácil para todos usar la IA, y liderar el camino en estándares internacionales esta vez es un punto de inflexión para convertirse en un país que lidere las normas de IA».

Lee Seung Yun, vicepresidente adjunto de la División de Investigación de Código Abierto y Estándares de ETRI, también dijo: «Las pruebas del equipo rojo de IA y las etiquetas de confiabilidad son elementos técnicos clave incluidos en las políticas regulatorias de IA en los EE. UU., la UE y otros países, y estos estándares internacionales servirán como criterios comunes para evaluar la seguridad y confiabilidad de los sistemas de IA en todo el mundo.

«ETRI continuará liderando la estandarización internacional en el campo de la seguridad y confiabilidad de la IA, convirtiendo a Corea en el centro de excelencia no solo para la IA soberana sino también para las tecnologías de seguridad de la IA soberana».

Citación: Investigadores coreanos proponen estándares internacionales para garantizar la seguridad y confiabilidad de la IA (2025, 30 de octubre) recuperado el 30 de octubre de 2025 de https://techxplore.com/news/2025-10-korean-international-standards-ai-safety.html

Este documento está sujeto a derechos de autor. Aparte de cualquier trato justo con fines de estudio o investigación privados, ninguna parte puede reproducirse sin el permiso por escrito. El contenido se proporciona únicamente con fines informativos.