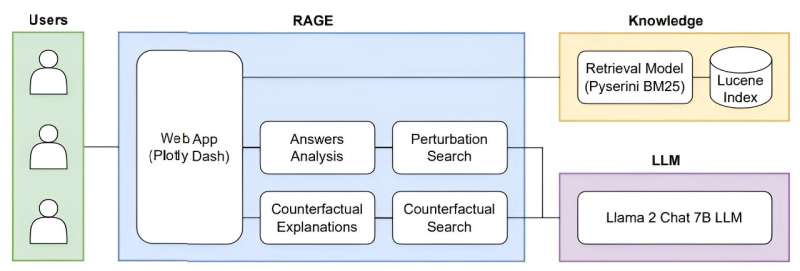

La arquitectura de RAGE. Crédito: arXiv (2024). DOI: 10.48550/arxiv.2405.13000

Un equipo de investigadores de la Universidad de Waterloo ha creado una nueva herramienta, apodada «RAGE», que revela de dónde obtienen su información los grandes modelos de lenguaje (LLM) como ChatGPT y si se puede confiar en esa información.

Los LLM como ChatGPT dependen del «aprendizaje profundo no supervisado», estableciendo conexiones y absorbiendo información de Internet de maneras que pueden ser difíciles de descifrar para sus programadores y usuarios. Además, los LLM son propensos a sufrir «alucinaciones», es decir, escriben de manera convincente sobre conceptos y fuentes que son incorrectos o inexistentes.

«No necesariamente se puede confiar en que un LLM se explique por sí solo», dijo Joel Rorseth, un doctorado en informática de Waterloo. estudiante y autor principal del estudio. «Podría proporcionar explicaciones o citas que también ha inventado».

La nueva herramienta del equipo de Rorseth emplea una estrategia desarrollada recientemente, llamada «generación de recuperación aumentada» (RAG), para comprender el contexto de las respuestas de los LLM a un mensaje determinado.

«RAG permite a los usuarios proporcionar sus propias fuentes a un LLM para contextualizar. Nuestra herramienta ilustra cómo diferentes fuentes conducen a diferentes respuestas cuando se usa RAG, lo que ayuda a evaluar si esa información es confiable», dijo Rorseth.

Debido a que su herramienta se centra en la explicabilidad de la generación aumentada de recuperación, la apodaron «‘RAGE’ contra la máquina».

Comprender de dónde obtienen su información los LLM como ChatGPT, y asegurarse de que no repitan información errónea, solo será más importante a medida que industrias altamente sensibles y centradas en las personas, como los sectores médico y legal, adopten estas herramientas, dijo Rorseth.

«Estamos en un lugar en este momento donde la innovación ha superado a la regulación», dijo. «La gente utiliza estas tecnologías sin comprender sus riesgos potenciales, por lo que debemos asegurarnos de que estos productos sean seguros y dignos de confianza».

La investigación, «RAGE Against the Machine: Retrieval-Augmented LLM Explanations», se publicará en las Actas de la 40ª Conferencia Internacional IEEE sobre Ingeniería de Datos. Actualmente es disponible sobre el arXiv servidor de preimpresión.

Más información:

Joel Rorseth et al, RAGE Against the Machine: Explicaciones de LLM con recuperación aumentada, arXiv (2024). DOI: 10.48550/arxiv.2405.13000

Citación: Conozca su fuente: la herramienta RAGE revela las fuentes de ChatGPT (2024, 4 de junio) obtenido el 4 de junio de 2024 de https://techxplore.com/news/2024-06-source-rage-tool-unveils-chatgpt.html

Este documento está sujeto a derechos de autor. Aparte de cualquier trato justo con fines de estudio o investigación privados, ninguna parte puede reproducirse sin el permiso por escrito. El contenido se proporciona únicamente con fines informativos.

GIPHY App Key not set. Please check settings