El proveedor de nube de datos Snowflake ha lanzado un modelo de lenguaje grande de código abierto, Arctic LLM, como parte de una cartera cada vez mayor de ofertas de inteligencia artificial que ayudan a las empresas a aprovechar sus datos. Los casos de uso típicos incluyen análisis de datos, incluido el análisis de opiniones de reseñas, chatbots para servicio al cliente o ventas, y consultas de inteligencia empresarial, como la extracción de información sobre ingresos.

Arctic de Snowflake se ofrece junto con otros modelos LLM de Meta, Mistral AI, Google y Reka en su producto Cortex. que solo está disponible en regiones seleccionadas. Snowflake dijo que Cortex estará disponible en APAC en Japón en junio a través de la región AWS Asia Pacífico (Tokio). Se espera que la oferta se lance a clientes de todo el mundo y del resto de APAC con el tiempo.

Arctic también estará disponible a través de Amazon Web Services hiperescalador, así como otros jardines modelo y catálogos utilizados por empresas, que incluyen Hugging Face, Lamini, Microsoft Azure, el catálogo API de NVIDIA, Perplexity, Together AI y otros, según la compañía.

¿Qué es el Ártico Copo de Nieve?

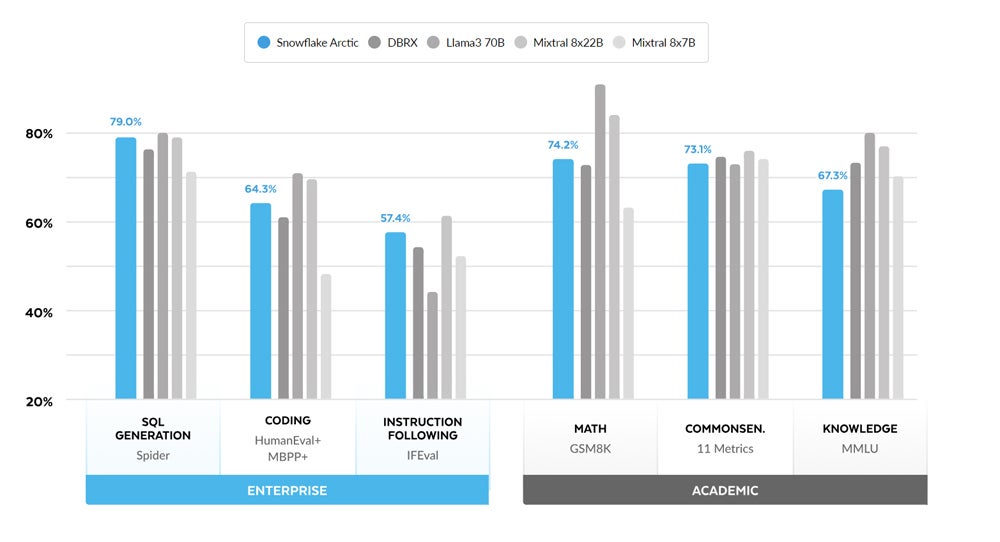

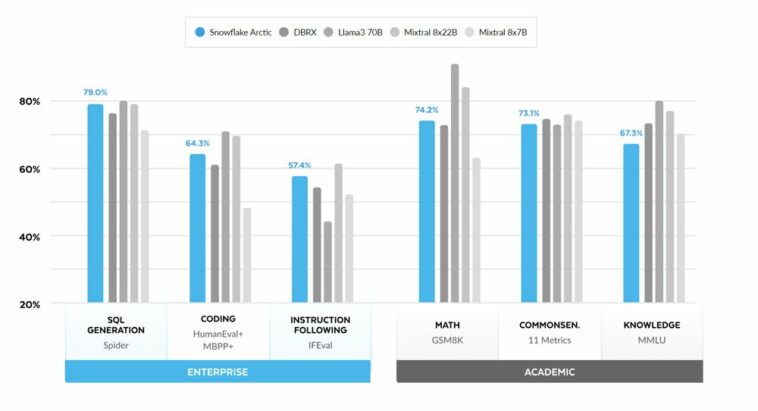

Arctic es el nuevo LLM “de última generación” de Snowflake, lanzado en abril de 2024, diseñado principalmente para casos de uso empresarial. La empresa ha compartido datos que muestran que Arctic obtiene una buena puntuación frente a otros LLM en varios puntos de referencia, incluida la generación de código SQL y el seguimiento de instrucciones.

El jefe de IA de Snowflake, Baris Gultekin, dijo que el LLM tardó tres meses en construirse (una octava parte del tiempo que otros modelos) con un presupuesto de 2 millones de dólares. Este logro hace que el modelo vaya más allá de lo rápido y económico que se puede desarrollar un LLM de nivel empresarial.

¿Cuáles son los diferenciadores clave de Snowflake Arctic?

El objetivo de Arctic LLM es proporcionar “inteligencia eficiente”; sobresale en tareas empresariales comunes y, al mismo tiempo, es más económico de usar al entrenar modelos de IA personalizados en datos empresariales. También está superando los límites del código abierto, ya que se lanzó con una licencia Apache 2.0 de código abierto.

En lugar de tomar la comprensión del mundo de propósito general que ofrecen muchos otros LLM de código abierto, que incluyen los modelos Llama de Meta, el modelo Arctic AI tiene como objetivo satisfacer específicamente la demanda empresarial de «copilotos de datos SQL conversacionales, pilotos de código y chatbots RAG».

VER: Zetaris sobre los lagos de datos federados y el lío de datos empresariales

Capacidades en “inteligencia empresarial”

Snowflake creó su propia métrica de «inteligencia empresarial» para medir el desempeño del LLM, que era una combinación de capacidades de codificación, generación de SQL y seguimiento de instrucciones.

Arctic salió favorablemente frente a los modelos de Databricks, Meta y Mistral en pruebas de evaluación comparativa de modelos de IA comunes, que desafían y proporcionan una puntuación porcentual para los modelos LLM en dominios de capacidad específicos. Según Snowflake, la capacidad del modelo para sobresalir en inteligencia empresarial cuando se compara con LLM con presupuestos más altos fue notable.

Eficiencia de entrenamiento e inferencia.

Gultekin dijo que Arctic AI LLM ofrece a los clientes empresariales una forma de capacitar LLM personalizados utilizando sus propios datos de una manera más rentable. El modelo también está diseñado para realizar inferencias eficientes a fin de que las implementaciones empresariales sean más prácticas y de menor costo.

Código abierto con Apache 2.0

Snowflake hace que Arctic LLM sea de código abierto con una licencia Apache 2.0 se debe en parte a lo que, según Gultekin, es la profunda experiencia del equipo de IA en código abierto. Esto significa que la empresa proporciona acceso a pesos y códigos, así como a recetas de datos y conocimientos de investigación.

Snowflake cree que la industria y el producto en sí podrán avanzar más rápido a través de contribuciones genuinas de los desarrolladores de código abierto, mientras que Gultekin dijo que poder ver debajo del capó ayudaría a los clientes empresariales a confiar más en el modelo.

¿Cómo afectará Snowflake Arctic al mercado de la IA?

El lanzamiento Arctic de Snowflake causó sensación en la comunidad tecnológica y de datos empresariales, gracias a su velocidad, eficiencia y capacidades de generación de SQL. Gultekin dijo que la decisión de la empresa de «ir más allá del código abierto» ha generado entusiasmo en la comunidad de investigación.

VER: Nuestra comparación de Snowflake con Azure Synapse Analytics

“Este es nuestro primer lanzamiento y establece un punto de referencia realmente bueno. El mercado va a evolucionar de tal manera que no habrá un único ganador; en cambio, todos los clientes están muy interesados en elegir en el mercado. Ya hemos visto un gran uso y esperamos que continúe”, dijo.

¿Snowflake tiene experiencia en IA?

Snowflake ofreció anteriormente una serie de soluciones de aprendizaje automático. Como parte del auge de la IA generativa en 2023, adquirió varias organizaciones de IA, incluidas empresa de búsqueda de datos Neeva y NXYZ, una empresa de la que Gultekin era director ejecutivo y cofundador. Desde entonces, Snowflake ha desarrollado su plataforma central de IA generativa, capacidades de búsqueda de IA y ahora está agregando modelos LLM.

GIPHY App Key not set. Please check settings